1.-INTRODUCCIÓN

La forma de la oreja es una importante herramienta para la identificación de personas. Su uso como característica biométrica proporciona ventajas, como la posibilidad de usarlo de forma remota (por ejemplo, sobre videos de videovigilancia). A diferencia de otras imágenes biométricas, las orejas no se ven afectadas por las expresiones faciales [11] y su reconocimiento puede tratar con variaciones de poses de hasta 13 grados y oclusiones de hasta un 18% [3]. Sin embargo, en muchos sistemas biométricos para la identificación de orejas, es importante un paso de normalización geométrica y fotométrica de forma automatizada [7].

Es en esta etapa de normalización donde se corrigen los desplazamientos en las imágenes resultantes y, en los procesos espaciales, como la corrección de la posición del origen, los ejes de referencia y la escala en el espacio. Estos desplazamientos y las variaciones en la posición y la pose afectan significativamente los resultados en las etapas posteriores del reconocimiento. En el caso de representaciones que dependen de las posiciones del origen y los ejes de coordenadas, como las representaciones funcionales, es fundamental una etapa de alineación [4]. Algunas desviaciones pueden ser corregidas por transformaciones afines o rígidas. Sin embargo, en casos donde existen variaciones de poses, las transformaciones no rígidas son comúnmente requeridas.

El proceso de alineación incluye un paso de preprocesamiento para el suavizado y la eliminación del ruido. Los métodos y pasos para alinear son diferentes para cada tipo de datos y están relacionados con su propia geometría [4]. Una de las formas más populares de trabajo consiste en la detección de puntos, curvas o formas para obtener una correspondencia entre ellos mediante una transformación conocida como “detección de características”. La peculiar forma de la oreja dificulta la detección precisa de los puntos característicos para la alineación, específicamente cuando se pierden uno o más puntos. Otro método es el basado en intensidades, que no necesita la detección de puntos característicos, curvas o formas. Este método se basa en la correlación en el dominio de la frecuencia (Dominio de Fourier) [2] o en la Información mutua [8].

En este trabajo, se propone aplicar un método basado en información mutua entre imágenes de orejas para su alineación. Esta solución es robusta ante la presencia de los efectos de la variación de la iluminación, y ante las diferencias en la región de interés resultantes de la segmentación, oclusión y ruido. El documento está organizado de la siguiente manera: en la sección 2 se explican algunos de los métodos de alineación incluyendo el propuesto; los experimentos realizado para evaluar este método, así como los resultados y discusión, se informa en la sección 3 y, por último, las conclusiones en la Sección 4.

2.- ALINEACIÓN DE IMÁGENES DE OREJAS

Existen desviaciones durante el registro de las imágenes debido a errores instrumentales en los procesos de captura de información o a la propia naturaleza física de los fenómenos en estudio, lo que dificulta su análisis y comparación. Por esta razón, dentro de los pasos del procesamiento de la imagen, la alineación es esencial para lograr buenos resultados en los sistemas reconocimiento. La alineación persigue, como objetivo, tanto la corrección fotométrica como geométrica de las imágenes, que incluyen la normalización de las intensidades de los píxeles, la corrección de las posiciones del origen de coordenadas, de los ejes de referencia y de las escalas lo que hace posible que los objetos en cuestión sean comparables.

En el proceso de alineación de orejas se usa comúnmente curvas o puntos característicos para hacerlos corresponder con una plantilla definida [13]. En muchos de los trabajos de la literatura, estos puntos característicos son detectados manualmente [13], pero existen técnicas de alineación automatizadas; que incluye modelos de formas activas (en inglés active shape models) [14] o combinaciones de modelos de contornos activos y ovoides sobre contornos de oreja [15]. El método propuesto en [16] se basa en un algoritmo que intenta crear una transformación de homografía entre dos imágenes utilizando la coincidencia de puntos característicos encontrados utilizando una transformación de la característica invariante a la escala (SIFT, por sus siglas en inglés) [30]. Otros métodos se basan en la detección del borde externo de la oreja (hélice) para rotar o normalizar la oreja según la mayor distancia representada por el eje dominante de la oreja [17,18].

En otros trabajos se explota la forma elíptica de la oreja, utilizando la Regresión de la postura en cascada (en inglés CPR) [19]. Este es un método donde se aproxima la forma externa de la oreja a una elipse, y su posición es, a su vez, transformada para normalizar la oreja. Una limitante de este método es que solo resuelve problemas de rotación de la cara cuando esta se mueve en la dirección del cabeceo (en inglés pitch). Sin embargo, avances recientes en la alineación de puntos de referencia basados en cascada [20,21], también se pueden usar para las imágenes de orejas siempre que se disponga de datos debidamente anotados para el entrenamiento [22]. En [23] se introduce una base de datos anotada con puntos de referencia que se utilizan para crear modelos de oreja estadísticamente deformables [24] (ej. active appearance models [25], active shape models [26]) para imágenes tomadas desde entornos no controlados. En un trabajo más reciente [7] se utiliza la llamada técnica Muestra Aleatoria de Consenso (RANSAC por sus siglas en inglés) que estima la transformación en el plano de cada imagen de oreja, a una imagen promedio.

En este trabajo, se utilizan y comparan tres métodos de normalización de imágenes: el primero se basa en análisis de componentes principales (PCA), el segundo se basa en puntos de referencia o puntos fiduciales de la imagen utilizada en un proceso de interpolación y muestreo (warping), y el tercero es el método propuesto, basado en la información mutua (MI) de las imágenes.

2.1.- DOS TÉCNICAS BASADAS EN PUNTOS DE LA IMAGEN: PCA Y WARPING

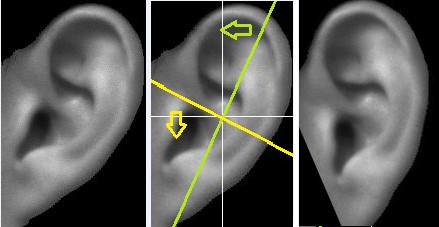

Para el caso de PCA (del inglés, Principal Component Analysis), una vez que la imagen de la oreja está segmentada, se normaliza geométricamente analizando sus componentes principales [6], y estas serán los nuevos ejes de coordenadas de los puntos en el plano que caracterizan la imagen, siendo su centroide el origen de este sistema de coordenadas. En la figura 1, se muestra un ejemplo de detección de las componentes principales y la rotación de la imagen. Es trivial que los ejes de coordenadas, así como su origen dependen de la región segmentada, y pueden cambiar, en particular, cuando se producen oclusiones o partes perdidas.

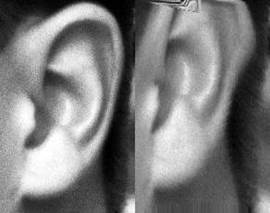

Otro método de alineación se basa en puntos característicos o puntos fiduciales, utilizados en un proceso de interpolación y muestreo (” warping”) [5]. El warping de una imagen es una transformación que mapea todas las posiciones en un plano de imagen a posiciones en un segundo plano. Surge en muchos problemas de análisis de imágenes, ya sea para eliminar las distorsiones ópticas introducidas por cámaras, o para alinear dos o más imágenes. Se seleccionó como patrón la oreja que respecto a las restantes logró la correlación más alta, siendo alineadas mediante el algoritmo COW (Correlation Optimized Warping, por sus siglas en inglés). La extracción incorrecta de puntos fiduciales trae consigo resultados erróneos en el proceso de alineación (Véase en la figura 3). En la figura 2 se muestran ejemplos de resultados en el proceso de alineación.

2.2.- INFORMACIÓN MUTUA

Los métodos de información mutua tienen su origen en la teoría de la información y es una medida de la dependencia estadística entre dos conjuntos de datos. Comienza con la estimación de la probabilidad conjunta de las intensidades de los píxeles correspondientes en las dos imágenes [12]. La información mutua (MI) entre dos variables aleatorias discretas

donde

Los primeros en proponerlo para la alineación de imágenes fueron Viola y Wells [8] en 1997 aplicado a imágenes médicas de resonancia magnética, las cuales tienen la característica de ser multimodales. Esta es una técnica estadística que se basa en la información que brinda la distribución de las intensidades en la imagen. Por lo tanto, es un método que no depende de que la imagen posea rasgos distintivos y es robusto ante efectos de iluminación, oclusión y ruido.

En el presente trabajo se propone un método de normalización geométrico con una métrica basada en la información mutua y se presenta un diagrama mostrado en la figura 4, representando el método de alineación de imágenes basados en la intensidad.

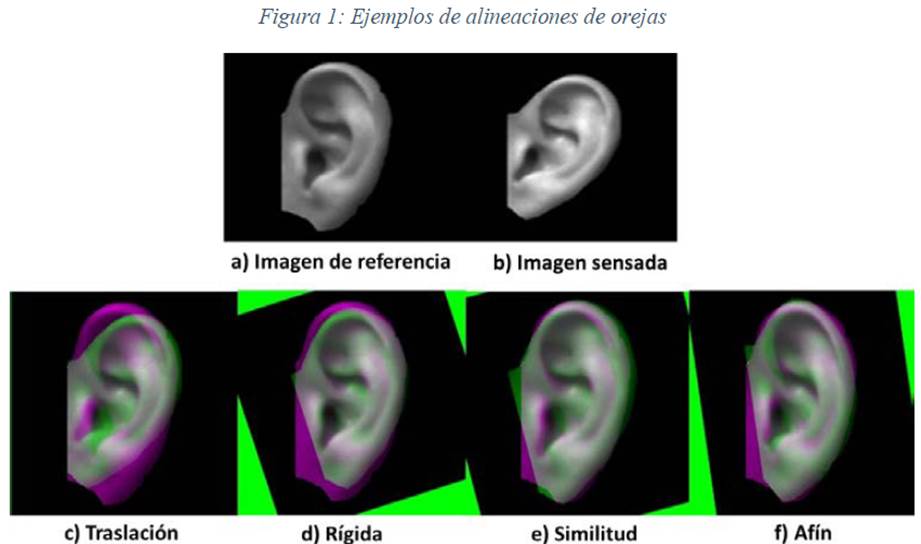

Un problema típico de alineación involucra una imagen de referencia y una imagen a alinear (imagen censada). Los métodos de normalización geométrica buscan determinar una transformación que aumente lo más posible la similitud (en el sentido de coincidencia en la posición y pose) entre la imagen censada y la imagen de referencia [14]. El objetivo del método es buscar iterativamente la transformación geométrica que, al ser aplicada a la imagen censada, maximice o minimice la métrica de similitud. La métrica de similitud, también conocida como función de costo, se basa en la distribución de las intensidades de los píxeles y se determina en las regiones superpuestas de las imágenes de entrada. La función del optimizador es determinar la estrategia de búsqueda [6].

Modelo de transformación e Interpolación

Un factor clave para el éxito del algoritmo presentado es la elección correcta del modelo de transformación, que depende en gran medida de la naturaleza de los datos. Existen dos tipos de transformaciones: rígida (preserva todas las distancias y ángulos internos) y no rígidas (pueden deformar la imagen) y dentro de estas encontramos las transformaciones de: traslación, rotación, similitud, afín (Véase en la figura 5). De nuestro interés son las transformaciones afines (incluye traslación, rotación, escala e inclinación).

Cuando una imagen es transformada, en ocasiones es necesario interpolar para determinar el valor del pixel cuya posición no es entera (posiciones no rígidas). La interpolación es realizada para aproximar los valores de los puntos transformados [28]. Entre las más comunes existen la interpolación del vecino más cercano, la bilineal, y la bicúbica. La interpolación del vecino más cercano no brinda una buena aproximación. La interpolación bicúbica, en ocasiones puede generar valores fuera del rango deseado. Por lo tanto, el más indicado es el interpolador bilineal.

Métrica de similitud

La eficacia de las transformaciones antes señaladas se evalúa calculando una métrica de similitud que mida la semejanza entre dos imágenes. Un buen indicador de similitud depende de la naturaleza del enfoque de la alineación. Cuando este proceso de alineación se realiza entre imágenes provenientes de diferentes sensores es común que haya mucha diferencia entre las intensidades de los píxeles. La información mutua es una de las técnicas más adecuadas para comparar la información entre las distribuciones de los píxeles [30]. La Información Mutua Normalizada (NMI, por sus siglas en inglés del término Normalized Mutual Information) da una mejor medida de similitud y se obtiene [27]:

Donde H(A) y H(B) son las entropías marginales de las imágenes A y B respectivamente, y H (A, B) la entropía conjunta definidas como

donde

Para obtener los valores de las distribuciones de probabilidad se suelen utilizar los histogramas. En el caso del histograma de una imagen se calcula el número de coincidencias de las intensidades dentro de un conjunto de intervalos definidos [27]

Procedimiento de optimización

La métrica de similitud se puede entender como una función de n-dimensiones, donde n representa los grados de libertad de la transformación utilizada [31]. Para una buena alineación, se supone que el óptimo de esta función corresponde a la transformación que realiza correctamente la alineación. La función del método de optimización es encontrar el mínimo de la medida de similitud empleada. Cada algoritmo de optimización emplea una estrategia de búsqueda diferente que depende de la naturaleza del algoritmo [30]. El enfoque utilizado en esta investigación es realizar la búsqueda directamente en el espacio de los parámetros de transformación. Para ello fue empleado un método procedente de los algoritmos evolutivos. Estos son métodos de optimización especialmente útiles cuando nos encontramos con problemas de alta dimensionalidad, multimodalidad, fuerte no linealidad y cuando se requiere de una solución global [32]. La estructura general de los algoritmos evolutivos responde al esquema mostrado en la Figura 6:

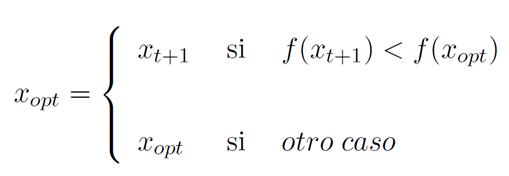

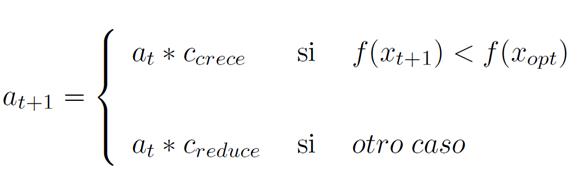

El optimizador empleado es conocido como Estrategia Evolutiva (1+1) [33]. El algoritmo de este optimizador puede ser implementado fácilmente, donde se itera hasta encontrar un conjunto de parámetros que produzcan el mejor resultado posible. Siguiendo los pasos del esquema general mostrado en la Figura 6, el algoritmo comienza con un vector de parámetros llamado padre inicial o generación 0 que puede ser introducido por el usuario. Este parámetro inicial es evaluado en la alineación de las imágenes para establecer una referencia. El siguiente paso es mutar los parámetros del padre dado por:

donde

En este paso se evalúa los resultados del hijo. Si mejora, pasa a ser el nuevo padre cuyos parámetros han sido mutados, quizás de forma más agresiva. Si el padre produce un mejor resultado, sigue siendo el padre y la siguiente mutación es menos agresiva. De esta forma solo tienen descendencia los que brinden buenos resultados. El factor de mutación

donde

3.- RESULTADOS EXPERIMENTALES Y DISCUSIÓN

Se compararon los métodos de alineación explicados en las anteriores secciones utilizando la base de datos UBEAR. Estos experimentos se explican con más detalles es las siguientes subsecciones

3.1.- BASE DE DATO

Las imágenes de oreja utilizadas en este documento corresponden a la base de datos UBEAR [9]. Esta base de datos tiene imágenes en escala de grises, lo que implica que solo se trabajarán los espacios de las intensidades incluidas entre 0 y 255. Las orejas con oclusiones superiores al 18% (considerando que quedan al descubierto las partes fundamentales de la oreja) y las variaciones de poses mayores de 13 grados se descartaron. Tras los procesos de detección y segmentación de la oreja, quedan 2023 imágenes de 127 sujetos, para su posterior alineación. Para evaluar los resultados de la alineación anterior, cada imagen se dividió 16 secciones iguales para que las partes no ocluidas entre las diferentes imágenes coincidieran.

3.2.- REPRESENTACIÓN FUNCIONAL

Cada sección de la imagen estaba representada por un B-spline de productor tensorial [29] dado por la fórmula 2,

donde

3.3.- RESULTADOS EXPERIMENTALES

Los experimentos de identificación se llevaron a cabo comparando los coeficientes de las funciones correspondientes de las imágenes de la oreja. Las imágenes se alinearon utilizando como patrón la imagen con la mayor correlación con el resto del conjunto de datos. Los resultados experimentales de identificación de las orejas derechas e izquierdas se presentan en las tablas 1 y 2, respectivamente. Las filas corresponden a los métodos de normalización PCA y geometrías de MI y las columnas corresponden a sus respectivos valores de éxito, fallos y porcentaje de eficiencia. Para cada región disjunta de la imagen, se calcularon 72 coeficientes de la función.

Tabla 1 Precisión de identificación de rango 1 en 1027 orejas izquierdas de 127 sujetos en la base de datos UBEAR

| Métodos | Genuinos | Impostores | Precisión (%) |

|---|---|---|---|

| PCA-Warping | 897 | 130 | 87.34 |

| Método Propuesto | 908 | 119 | 88.41 |

Tabla 2 Precisión de identificación de rango 1 en 970 orejas derechas de 127 sujetos en la base de datos UBEAR

| Métodos | Genuinos | Impostores | Precisión (%) |

|---|---|---|---|

| PCA-Warping | 808 | 162 | 83.29 |

| Método Propuesto | 836 | 134 | 86.28 |

Como se muestran en estas tablas, el método propuesto obtuvo mejores resultados que la combinación del PCA y warping en ambas orejas. Debido a problemas de oclusión, de manera general, los resultados no fueron elevados, aunque el método propuesto es menos sensible a estos problemas, ya que PCA depende de toda la región visible para encontrar sus componentes principales, y en el caso del warping, si los puntos fiduciales que se requieren, son de regiones oclusas no será posible obtenerlos y afectará seriamente el resultado final. El resultado de los experimentos muestra un incremento de aproximadamente del 3 % en la precisión de la identificación; sin embargo, el proceso de normalización para una imagen toma aproximadamente 1.5 segundos, lo que representa un aspecto a tener en cuenta al utilizar este método en un sistema de reconocimiento; aunque se pudiera valorar la posibilidad de utilizar otros optimizadores con el objetivo de reducir el tiempo de procesamiento del método.

4.- CONCLUSIONES

La alineación de la imagen es un paso fundamental en los sistemas de reconocimiento. La iluminación variable, las oclusiones y las variaciones de poses son problemas que afectan seriamente los resultados del reconocimiento en sistemas biométricos. En este documento, presentamos una solución de alineación basada en información mutua de imágenes de orejas para tratar estos problemas, mejorando así la precisión del proceso de reconocimiento cuando se utiliza la representación funcional.

Los resultados experimentales muestran que, ante los problemas de oclusión y variaciones de poses, el método propuesto es más factible para la etapa de alineación de imágenes de orejas, no siendo así para la de identificación. Esto se debe a que la PCA y los métodos de deformación son más sensibles cuando alguna parte importante de la oreja no está presente en la imagen. En contraste, la propuesta basada en información mutua no depende de tener características o regiones distintivas en la imagen y es robusta a los efectos de la iluminación, la oclusión y el ruido.

Además, anteriormente se ha utilizado información mutua para registrar imágenes de satélites, imágenes médicas, etc. [8], donde, por lo general, las imágenes que deben alinearse corresponden al mismo objeto o región original, a diferencia del método propuesto en este trabajo, donde las imágenes de la oreja de referencia y de la oreja censada pueden no ser de la misma persona, y aun así se obtienen resultados satisfactorios.

Para trabajos futuros, se surgiere comparar el método propuesto con otros métodos de alineación de la última generación, así como mejorar la eficiencia del método.