Introducción

En la actualidad, la calidad de la energía eléctrica (PQ, siglas en inglés de Power Quality) y el suministro de esta se han convertido en una seria preocupación entre suministradores, consumidores, fabricantes de equipos e investigadores [1-3]; dado su impacto directo, desde el punto de vista económico, en los sectores industrial y doméstico, lo que afecta el desarrollo de cualquier nación [4,5].

La PQ comprende un amplio rango de fenómenos electromagnéticos cuyas principales causas radican en la presencia cada vez mayor dentro del sistema eléctrico de elementos no lineales [1,6]. Desde el punto de vista del dominio del tiempo, los disturbios de PQ pueden ser continuos o discretos. Los disturbios continuos: distorsión de la forma de onda (armónicos e interarmónicos), desbalance, fluctuación y desviación de la tensión están presentes en cada ciclo de la forma de onda, mientras que los disturbios discretos, tales como interrupciones, huecos de tensión (sags) y sobretensiones (swells), aparecen como eventos aislados e independientes [4,7]. Las interrupciones son disminuciones de la tensión por debajo del 10% de su valor nominal. Estas pueden ser el resultado de fallas en el sistema, equipos averiados o debidas al mal funcionamiento de los sistemas de control. Los sags se caracterizan por una disminución de tensión entre el 10 y 90% del valor nominal con duraciones menores a un segundo y asociado a fallas en el sistema como cortocircuitos y conexión de grandes cargas. Los swells son incrementos superiores al 110% de la tensión nominal, relacionados a conexión de grandes bancos de capacitores o desconexión de grandes motores [8].

En la mayoría de los circuitos de distribución de Cuba se encuentran instalados dispositivos de medición capaces de ofrecer una visión efectiva del comportamiento de la calidad de la energía en el sistema. Distintas variables de medición de PQ, en particular las correspondientes a los disturbios de tipo discreto, no están siendo explotadas íntegramente por la Unión Eléctrica. Teniendo en cuenta lo anterior, el objetivo general de la investigación es caracterizar parámetros discretos de calidad de energía en circuitos eléctricos de distribución, en específico sags y swells, toda vez que, en el caso de las interrupciones, las mismas se asocian en mayor medida a estudios de fiabilidad. Dicha caracterización parte del empleo de técnicas estadísticas y las curvas de tolerancia a las variaciones de tensión. La metodología es aplicada a las mediciones de campo disponibles.

Media y desviación estándar de variables aleatorias

El valor esperado o media es la medida de tendencia central de uso más frecuente. Suponiendo un resultado de n mediciones o datos de un determinado parámetro, los que se denotan por x 1 , x 2 , …, x n , su promedio, denotado como ẋ, viene dado por la ecuación (1):

Si se repitieran algunas de estas mediciones, como, por ejemplo: n 1 es el número de datos con valor x 1 , n 2 es el número de datos con valor x 2 , … n k es el número de datos con valor x k , resultando la ecuación (2):

El promedio se determina por la ecuación (3), de la manera siguiente:

Conociendo que la frecuencia relativa de un resultado se define como el número de veces que aparece dicho resultado entre el número total de pruebas, se define dicho parámetro por la ecuación (4):

La ecuación (3), resulta: vea ecuación (5)

Por otro lado, según la definición de probabilidad, es posible tomar la frecuencia relativa como una medida de la probabilidad de ocurrencia de un evento específico, cuando el número de pruebas es relativamente alto y existe estabilidad en el valor de las frecuencias, por lo que sustituyendo las frecuencias f i por los valores de probabilidad, se obtiene la ecuación (6):

Esta suma da una medida de la tendencia central del conjunto de valores x i y se conoce como valor esperado o media de la variable.

La desviación típica o estándar se expresa a través de la ecuación (7): [9]

Estimación puntual de la media

Muchas veces se requiere el estudio de un conjunto de objetos homogéneos respecto a cierto índice cualitativo o cuantitativo que caracteriza a estos objetos. En ocasiones se puede realizar una investigación total, es decir, se examina cada uno de los objetos del conjunto respecto al índice que interesa. Pero en la mayoría de las situaciones esto no es posible, porque el conjunto es muy grande o infinito, o, por ejemplo, porque el estudio lleva implícito un conjunto considerable de gastos materiales o la destrucción del objeto de estudio. En estos casos se escogen fortuitamente del total un número limitado de objetos y se someten los mismos al estudio. A este subconjunto se le llama conjunto muestral o simplemente muestra y se asocia con el conjunto general o población del cual se extrae. La estimación de los parámetros de una población consiste en aplicar métodos por medio de los cuales se calculan los parámetros de la muestra de manera que sean significativamente confiables para extenderlos a la población.

La mayoría de las distribuciones de probabilidad dependen de cierto número de parámetros. En el caso específico de la distribución normal, esta depende de la media poblacional μ y la desviación estándar poblacional σ[10]. En el presente estudio interesa la estimación de estos parámetros a partir de los datos, básicamente, empleando una estimación puntual.

El objetivo de la estimación puntual es usar una muestra para obtener un valor que sea el que mejor represente el verdadero valor del parámetro, es decir, que tenga el menor error de estimación. Una primera propiedad deseable en los estimadores es que sea insesgado, lo que significa que su distribución de probabilidad muestral siempre estará centrada en el valor verdadero del parámetro que estima; y la segunda propiedad importante es que, una vez insesgado, el estimador posea la menor varianza.

El estimador resultante es conocido como estimador insesgado de varianza mínima (MVUE, siglas en inglés de minimum variance unbiased estimator). En una muestra aleatoria con distribución normal, la media muestral es el MVUE de μ, y se calcula según la ecuación (1). Aunque la desviación estándar muestral no es un estimador insesgado de σ, puede usarse para la estimación si n es suficientemente grande, determinándose por la ecuación (7) [10].

Histogramas de probabilidad

Los histogramas de probabilidad son gráficos de barras para representar las variables aleatorias. Pero para realizar la representación gráfica de dichas variables primeramente se requiere la construcción de tablas de frecuencia. Para ello se divide el conjunto de observaciones de la variable en clases, delimitadas en intervalos que dependen del problema en cuestión. Una vez confeccionadas las clases, los datos pueden ser distribuidos en frecuencias absolutas, que se define como el número de datos del conjunto original que pertenecen a una determinada clase.

Un histograma es también un estimado de la distribución de probabilidad de una variable obtenida a partir de un conjunto de observaciones [11].

Distribución de probabilidad normal o de Gauss

El modelo de probabilidad normal o de Gauss es el de mayor aplicación en el campo de las estadísticas y las probabilidades. Entre sus grandes ventajas están:

La función de densidad probabilística (PDF, siglas en inglés de probability density function) normal puede modelar el comportamiento de muchos procesos de la vida práctica.

Los procesos que no siguen un comportamiento normal pueden ser aproximados a este mediante la combinación de funciones de distribución normales con apropiadas media y desviación estándar.

Los métodos de estimación basados en modelos normales generalmente conducen a modelos lineales de soluciones menos complejas matemáticamente.

La suma de muchos eventos aleatorios independientes tiene una distribución normal, lo cual se conoce como el teorema del límite central.

Una variable aleatoria X distribuida normalmente es descrita por la PDF que se muestra en la ecuación (8):

Por su parte, la función de distribución acumulada (CDF, siglas en inglés de cumulative distribution function) de dicha variable viene dada por la ecuación (9): [11]

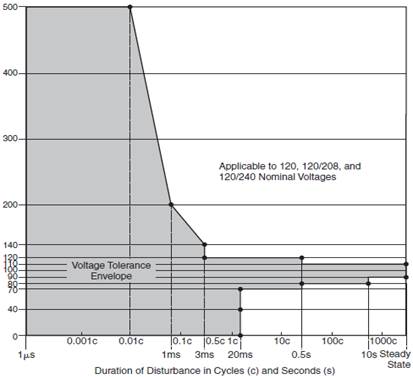

Los equipos pertenecientes a los usuarios, en general, pueden verse afectados por estos eventos de corta duración. Uno de los métodos más comunes para cuantificar la susceptibilidad del equipo es usando las conocidas curvas de tolerancia a las variaciones de tensión, o curvas de aceptabilidad de potencia, las cuales se grafican en planos de desviación de tensión en por ciento contra tiempo de duración de la variación, normalmente expresado en segundos o en ciclos de la componente fundamental y en escala logarítmica.

Existen varias curvas de tolerancia de tensión, pero la más ampliamente usada es la curva CBEMA (siglas en inglés de Computer and Business Equipment Manufacturers Association). Esta curva fue creada en la década de los 70 del pasado siglo con el propósito inicial de proporcionar una medida de la vulnerabilidad de ordenadores a los disturbios presentes en el sistema eléctrico de suministro. Sin embargo, su uso ha sido extendido también para dar una medida de la calidad de la energía para dispositivos de accionamiento eléctrico, cargas de estado sólido, así como otras cargas residenciales, comerciales e industriales. La misma fue modificada en 1996 y renombrada como ITI (siglas en inglés de Information Technology Industry Council), la cual surgió para equipos de computación de 120 V RMS y 60 Hz, aunque, al igual que su predecesora, se aplica para la evaluación general de PQ [8]. La figura 1 muestra dicha curva.

Ambas gráficas difieren en la manera que es presentada su región de aceptabilidad, ya que la curva CBEMA limita esta región mediante una curva, mientras que la ITI la limita mediante pasos. Ambas curvas han sido aceptadas como normas y publicadas en las versiones recientes IEEE 446 e IEEE 1100.

Otras normativas de interés en este sentido son la SEMI (siglas en inglés de Semiconductor Equipment and Materials International) F47-0706 [12], desarrollada para tratar el impacto económico asociado a la sensibilidad del equipamiento a sags en la industria de semiconductores, y las correspondientes a la serie IEC (siglas en inglés de International Electrotechnical Commission) 61000 [13,14].

Las curvas CBEMA e ITI simbolizan la variación de tensión (ΔV) y representan el caso de tensión al valor nominal, mientras que los semiplanos ΔV < 0 y ΔV > 0 corresponden a las regiones de tensión inferior y superior al valor nominal respectivamente. La región entre los dos lados de la curva representa la zona de tolerancia dentro de la que se espera que los equipos electrónicos sensibles funcionen correctamente. Cuando la tensión se encuentra por debajo de esta zona, el equipo puede funcionar mal o interrumpirse su funcionamiento, mientras que cuando la tensión está por encima, además del mal funcionamiento del equipo, pueden producirse daños en el mismo.

Resultados y Discusión

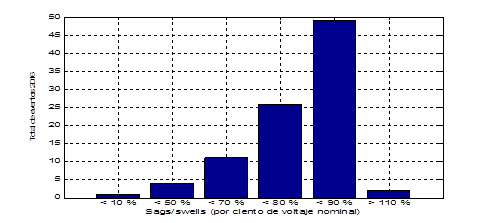

Seguidamente se caracterizan las lecturas de sags y swells realizadas por el ION 1200, situado en el municipio de Sagua La Grande, provincia Villa Clara. Dichas lecturas corresponden al año 2016. Los resultados obtenidos tras la aplicación de cada una de las técnicas estadísticas y de las curvas representativas en la caracterización de estos problemas reflejan la presencia de variaciones de tensión nocivas para equipos sensibles.

La figura 2, muestra el histograma de ocurrencia de sags y swells durante el período señalado. Como bien se refleja, la ocurrencia de swells fue baja, mientras que predominó la ocurrencia de sags con 49 casos. Las caídas de tensión entre 80 y 90% con respecto a la nominal fueron los de mayor incidencia.

Por su parte, la figura 3, refleja un histograma de función de densidad probabilística contra magnitud de los sags, los valores de mayor probabilidad se encuentran alrededor de la media, representada por la línea verde y con un valor aproximado de 0,7253 pu, reiterándose el predominio de los sags que se encuentran entre el 80 y 90%. Las líneas rojas indican un nivel de confianza entre el 5 y el 95% de que los parámetros analizados se hallen entre 0,23 y 0,89 pu en base a su tensión nominal.

Asimismo, el análisis de la figura 4, muestra que la mayor incidencia de sags presentó tiempos de duración inferiores a los 8.3 milisegundos.

Para obtener una mejor idea, se presenta la figura 5, que ilustra la distribución de probabilidad de Gauss de estas mediciones, donde se destacan los valores de probabilidad de 5 y 95%, que corresponden a valores de 1.5 y 171 ciclos respectivamente, o su equivalente 25 milisegundos y 2.83 segundos.

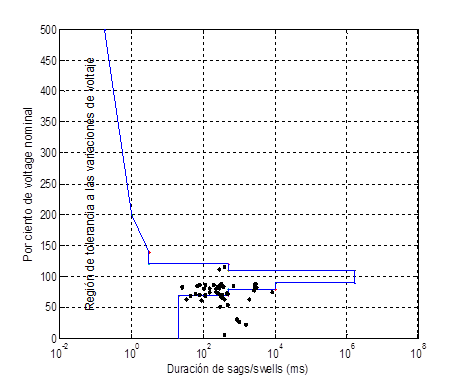

En la figura 6, se representa la curva ITI, donde los puntos simbolizan los sags y swells. Los que se encuentran dentro o próximos a la región de tolerancia resultaron los menos perjudiciales para los equipos sensibles, quedando alrededor de siete eventos de esta naturaleza que constituyeron un peligro eminente a dichos equipos debido a la duración de estos.

Conclusiones

Los sags y swells constituyen eventos discretos asociados generalmente a fallas en el sistema que afectan la calidad de la energía. En el trabajo se realizó la caracterización de estos fenómenos correspondientes al nodo 1200 de Sagua La Grande durante 2016, a través de histogramas de probabilidad y la estimación puntual y por intervalo, así como el uso de la curva ITI. Los resultados de la simulación de las mediciones destacan el predominio de sags con amplitudes entre 80 y 90% y duración media de 723 milisegundos, así como la existencia de siete eventos de esta naturaleza que pudieron haber afectado al equipamiento sensible de los usuarios.

La principal contribución del trabajo radica en la validación de una metodología sencilla pero efectiva para el logro del objetivo propuesto. Se evidencia que el registro continuo de estos fenómenos y su posterior tratamiento estadístico en circuitos de distribución de interés resultan fundamental para analizar el grado de afectación que suelen sufrir ciertas cargas conectadas a dichos circuitos.