Introducción

Hay muchas y posibles acepciones de la inteligencia artificial (IA), una de ellas es aquella que la define como “la ciencia y la ingeniería de fabricar máquinas inteligentes, en especial programas inteligentes de computación”, entendiendo por inteligente: “la parte de la informática orientada a obtener resultados” (Mccarthy, et al., 1955). Es decir, debe destacarse desde el principio, que este concepto de IA está relacionado con la inteligencia humana, pero no tiene por qué limitarse a criterios observables biológicamente.

El desarrollo de la IA permite vislumbrar un futuro no muy lejano de sistemas inteligentes con capacidades y soluciones impensables y del hombre dependerá que la IA acontezca ser una competidora o una leal colaboradora. Los efectos que tienen tales tecnologías en el funcionamiento de los sistemas judiciales y los valores avalados lleva a un contexto de claro propósito ético, en favor de las libertades individuales, “del interés general y bajo criterio de responsabilidad última de las personas por el hecho que algo sea posible desde un punto de vista tecnológico no se desprende necesariamente que resulte deseable”. (Villalta, 2020)

La más reciente ola tecnológica está basada en la inteligencia artificial y promete cambiar las condiciones en las que se toman las decisiones judiciales. Este objetivo se persigue sobre todo a través de la tecnología concreta conocida como “aprendizaje automático”, que hace predicciones a partir de evaluaciones de los expedientes judiciales, tanto de los documentos procesales como de las decisiones judiciales correspondientes. Este conjunto de datos, conocido como “datos de entrenamiento”, se analiza para elaborar correlaciones estadísticas entre los casos y las decisiones judiciales correspondientes.

El algoritmo, mientras más datos procesen más preciso se vuelve para predecir las decisiones de las causas nuevas. Por esta razón, estos sistemas “aprenden” (incluso si solo se trata de una precisión estadística mejorada) para replicar los resultados a los que llegaron los jueces en causas similares. A diferencia de las herramientas tecnológicas ya implantadas que digitalizan el intercambio de datos y documentos, esta tecnología de “justicia predictiva” (como muchas veces se la llama erróneamente) tiene como objetivo influenciar la toma de decisiones judiciales. No está claro si esta tendencia trasciende en decisiones más justas o si está socavando el funcionamiento correcto de la justicia. El impacto potencial de la IA en la administración de la justicia y la aplicación del derecho puede explorarse al considerar los problemas que presenta en el ámbito sanitario.

Así, la también llamada justicia digital pretende poner la tecnología al servicio del derecho para lograr resultados que el ser humano sería incapaz de conseguir sin usarla, su fin último es lograr una administración de justicia en la que la principal característica operativa sea la digitalización de los procesos desde su inicio hasta su conclusión, eliminando barreras de tiempo y espacio. La implementación de estas herramientas representa innumerables ventajas que deberían ser aprovechadas por el Estado de modo que exista un empleo más eficiente de los limitados recursos disponibles. Alcanzar este fin será sin duda alguna un avance significativo, pues conlleva un cambio sustancial en la forma de entender la justicia. Ese día se habrán superado numerosos retos y dificultades y se estará listo para dar un paso más, nuevamente hacia lo desconocido, porque con toda seguridad, para ese entonces el mundo de la robótica y de la inteligencia artificial ya habrán desarrollado suficientes herramientas útiles para atender las nuevas necesidades de la sociedad. Lograr una justicia 100% virtual toma tiempo, y requiere un plan de acción en el que se establezcan de forma clara los objetivos y los pasos para conseguirlos; de modo que, identificadas las necesidades, se han de comprender cuáles son las ventajas y limitaciones de realizar estos cambios para usarlos en pro de reinventar la forma de concebir la justicia aplicando la IA.

Teniendo en cuenta lo expuesto hasta el momento, se define como Problema a analizar: desconocimiento de las limitaciones de la aplicación de la inteligencia artificial al derecho. Por tanto, se expone como objetivo principal del trabajo: analizar las limitaciones de la aplicación de la inteligencia artificial al derecho.

Desarrollo

Para la realización del presente documento se utilizaron los siguientes métodos:

PESTEL:

El análisis PESTEL es una herramienta de planeación estratégica que sirve para identificar el entorno sobre el cual se diseñará el futuro proyecto, de una forma ordenada y esquemática (Pérez, 2018). El análisis estratégico determina la situación actual de la organización, con la finalidad de crear estrategias, aprovechar las oportunidades, o actuar ante posibles riesgos (Parada, 2013). La aplicación de PESTEL consiste en identificar y analizar el entorno en el que va a operar la empresa para luego actuar estratégicamente sobre él.

Se analizan los factores relacionados con la clase política que influyen en las actividades futuras de la empresa, las cuestiones económicas actuales y futuras que influyen en la aplicación de la estrategia, los factores socioculturales que ayudan a determinar las tendencias de la sociedad actual, el impacto de las nuevas tecnologías y los cambios que pueden producirse en el futuro, los posibles cambios relacionados con la ecología y los cambios en la normativa legal relacionada con el proyecto que pueden tener un impacto positivo o negativo. Todos los aspectos de esta técnica son cruciales, ya que no sólo ayuda a comprender el mercado, sino que constituye la columna vertebral de la gestión estratégica (Fig. 1).

Mapas Cognitivos Difusos (MCD):

Son un tipo de grafo cuyos vértices representan conceptos y sus aristas las relaciones causales entre estos. Fueron presentados por Kosko (1986), donde los valores que simbolizan relación están en el intervalo [-1, 1], e incluyen una gradación entre las relaciones de los conceptos (Saleh Al-Subhi, et al., 2018).

Los MCD han sido utilizados para modelar problemas en diversos ámbitos debido a las prestaciones y ventajas que ofrece desde su introducción como la escalabilidad en entornos dinámicos (Panagiotis, et al., 2010), la interpretabilidad de los resultados (Gregor, et al., 2017; Hatwagne, et al., 2018); (Vasantha, 2018), la agregación del conocimiento de múltiples expertos (Gray, et al., 2014; Solana-Gutiérrez, et al., 2017).

Los mapas cognitivos difusos ofrecen ventajas como:

La escalabilidad en entornos dinámicos (Panagiotis, et al., 2010): En las organizaciones orientadas a proyectos, el dinamismo es provocado por la evolución de las propias organizaciones a partir de la experiencia y los procesos de mejora haciendo que las alternativas también pueden cambiar.

La interpretabilidad de los resultados (Gregor, et al., 2017; Hatwagne, et al., 2018): En particular, en la gestión de proyectos es imprescindible que los expertos humanos puedan interpretar fácilmente las decisiones por las herramientas propuestas por los investigadores.

La agregación del conocimiento de múltiples expertos (Gray, et al., 2014; Solana-Gutiérrez, et al., 2017): En la modelación del proceso de toma de decisión en gestión de proyectos, deben intervenir varios expertos para disminuir el sesgo que se produce cuando interviene un único experto. El conocimiento de estos expertos debe ser agregado en una sola estructura de conocimiento.

La posibilidad de manejar información cualitativa (Papageorgiou, et al., 2006; Mpelogianni & Groumpos, 2018). Es más cómodo para los expertos en algunas ocasiones expresar sus preferencias en lenguaje natural, o sea, a través de información cualitativa, por ejemplo, sus preferencias asociadas al análisis de calidad y la motivación de los recursos humanos.

La capacidad para representar las relaciones retroalimentación e indeterminación que con frecuencia se presentan en las decisiones que se tomen durante el desarrollo de proyectos.

En los MCD existen tres posibles tipos de relaciones causales entre conceptos:

Causalidad positiva ( W 𝑖𝑗 > 0): Indica una causalidad positiva entre los conceptos C i y C j , es decir, el incremento (disminución) en el valor de C i lleva al incremento (disminución) en el valor de C j .

Causalidad negativa ( 𝑊 𝑖𝑗 < 0): Indica una causalidad negativa entre los conceptos 𝐶 𝑖 y 𝐶 𝑗 , es decir, el incremento (disminución) en el valor de C i lleva la disminución (incremento) en el valor de C j .

No existencia de relaciones ( 𝑊 𝑖𝑗 = 0): Indica la no existencia de relación causal entre C i y C j .

Para cumplir con lo expuesto en el objetivo se seguirá el siguiente algoritmo:

Modelar el MCD mediante un grado y su matriz de adyacencia.

Análisis estático. Las siguientes medidas se calculan para los valores absolutos de la matriz de adyacencia:

Outdegree, denotado por od (vi), que es la suma por cada fila de los valores absolutos de una variable de la matriz de adyacencia difusa. Es una medida de la fuerza acumulada de las conexiones existentes en la variable.

Indegree, denotado por id (vi), que es la suma por cada columna de los valores absolutos de una variable de la matriz de adyacencia difusa. Mide la fuerza acumulada de entrada de la variable.

La centralidad o grado total, de la variable es la suma de od (vi), con id (vi), como se indica a continuación:

td (vi)= od (vi) + id (vi) (1)

Clasificar las variables según el criterio siguiente:

Se ordenan de manera ascendente acorde al grado de centralidad.

Estudio de caso

Se dice que la inteligencia artificial hace que los procesos administrativos, judiciales y comerciales sean más eficientes y predecibles, con todo lo que ello implica de ahorro de costes. Junto a estas oportunidades, sin embargo, hay problemas técnicos asociados a elementos como los distintos formatos de datos digitales que impulsan las aplicaciones funcionales de la IA. Las dificultades expresadas en relación con el cumplimiento automatizado o algorítmico son dignas de mención, ya que afectan a cuestiones más que tópicas, como la transparencia, la responsabilidad y la capacidad de impugnar determinadas decisiones. La IA se está aplicando para comprender mejor el desarrollo del cerebro y optimizar así el diagnóstico de posibles casos.

Hay muchas cosas que se pueden hacer de forma automática para auxiliar a los profesionales. Estos sistemas prometen ayudar a evaluar de manera más eficiente y menos costosa. Es una herramienta más que trata de compensar las posibles limitaciones que puedan tener los profesionales en ciertas intervenciones. A la vista de estas novedades, parece interesante y quizás útil, reflexionar sobre la situación actual en Ecuador y en el mundo, de las perspectivas de la IA en su relación con el derecho. De ahí hasta qué punto la máquina es capaz de afectar o condicionar en un futuro próximo el trabajo, ¿aplican estas Derecho? En la medida de lo posible se avanzará en alguna conclusión sobre si alguna vez se verá a una máquina resolviendo conflictos jurídicos que surgen en el ámbito sanitario. En ese marco, se debe enfatizar que el tratamiento de la información es uno de los usos más comunes al momento de emplear la tecnología. En su aplicación a la justicia, este uso específico también ha sido referido por otros autores como Back Office, contemplado como un eje vital de apoyo al desenvolvimiento de las actuaciones de justicia. Así, el procesamiento de textos y bases de datos es el primer paso que ha de darse para la consecución eficiente de los demás usos posibles, tal como se explicará posteriormente.

El tratamiento de información en Ecuador se ha llevado a cabo por medio de la organización en bases de datos tanto de los procesos judiciales asignados con números y códigos de dependencia, así como de los profesionales del derecho que patrocinan esta causa. Estas bases de datos se nutren de toda la información que los operadores de justicia y las partes ingresan a los sistemas. A partir de estos datos relacionados y estructurados, los funcionarios son capaces de gestionar con mayor eficiencia los procesos a su cargo. Así, el tratamiento adecuado de la información permite realizar intercambios entre los juzgados y abogados, y por tanto, entre abogados y ciudadanos, enviar y recibir información de entidades públicas y otros auxiliares de la justicia en instantes. Por otro lado, el procesamiento de textos es eficiente y permite emitir providencias, autos y sentencias en base a plantillas de casos similares y relacionados que agilizan la gestión siempre que estos procesos no exijan un análisis particular del caso en concreto. Dentro de este punto también se deben considerar las bases de datos que se nutren de las últimas actualizaciones de normas, doctrina y jurisprudencia. En este ámbito, Ecuador cuenta con el sistema E-SIPJUR (Sistema de Procesamiento de Jurisprudencia 7) que permite ubicar precedentes jurisprudenciales obligatorios, resoluciones con fuerza de ley y sentencias, minimizando la posibilidad de impartir justicia con errores.

En lo que se refiere a sistemas unificados electrónicos que contienen las últimas actualizaciones y reformas de normas o jurisprudencia, han tomado papel protagónico algunas empresas privadas. A pesar de los constantes esfuerzos, hay que admitir que al momento en el país no se ha alcanzado el nivel de interoperabilidad deseado entre bases de datos que permitan cruzarlas con otras disponibles y verificar información para mitigar riesgos y evitar errores, pero se trabaja en ello y se espera alcanzar este objetivo a mediano plazo. Tampoco existe cabida aún para otros usos posibles relacionados a sistemas con técnicas de inteligencia artificial ya activos en otros países a los que se refiere a continuación brevemente. Países más desarrollados ya alcanzaron una interconexión eficiente de información, y por tanto, ya dejaron entrar al juego a la inteligencia artificial, estas naciones dedicadas a la investigación de las nuevas tecnologías aplicadas al derecho ya han perfeccionado y uniformado el lenguaje jurídico para obtener de esta manera mejores resultados al momento de realizar investigaciones en los buscadores. Otro avance significativo fue el primer sistema de enseñanza basado en casos, desarrollado por Kevin. Ashley, profesor de la Universidad de Pittsburg, experto en modelado informático del razonamiento jurídico y cuestiones legales, sistema denominado CATO.9. Así también, la información legal en bases de datos se utiliza en sistemas de asesoría jurídica (Legal Advisory Systems), y en otras aplicaciones legales, Split-up o SHYSTER en Australia, ASHSD-II en Inglaterra, CHIRON en Estados Unidos, o LASTC en Tailandia son algunos ejemplos, siendo sistemas de expertos legales que basados en datos, utilizan inteligencia artificial para emular las habilidades de toma de decisiones de un experto humano en el campo del derecho específico del que se trate. En otros países ya se trabaja activamente para la implementación de la inteligencia artificial mediante el “machine learning” o “procesamiento del lenguaje”, se tienen asistentes virtuales como Alexa, que absuelve con facilidad consultas de los usuarios en un lenguaje sencillo, también se consideran chatbots web entrenados e incluso ya se ha apostado porque los sistemas informáticos aprendan de los datos con los que se alimentan y empiecen a actuar sin guía del ser humano en tareas recurrentes como la gestión automatizada de documentos para incluirlos en el expediente judicial electrónico y tareas básicas en otros procedimientos repetitivos que inicialmente las realizaba una persona.

Se mentiría si se dijera que Ecuador está en posibilidades de implementar herramientas como las mencionadas, la iniciativa del expediente judicial electrónico en Ecuador es reciente, ni siquiera está disponible aún en todo el territorio nacional porque su implementación se hará por fases, priorizando las unidades judiciales de primer nivel y cortes provinciales, en espera de que en el 2021 esté operando a nivel nacional. Con lo dicho, es evidente que estos procesos son nuevos y todavía no cerrados, pero con su iniciación ya se reconoce el esfuerzo que el órgano de justicia ha puesto en llegar a una virtualización integral de los procesos judiciales, ya se aprecia de a poco la desmaterialización de algunos procedimientos, y como consecuencia lógica, la reestructuración de infraestructuras técnicas y organizativas a nivel nacional para adaptarse al uso de las nuevas herramientas tecnológicas.

De esta forma inicia en Ecuador la justicia electrónica, de a poco se presentan peticiones y documentos digitales, ya se está más pendientes de la propia casilla judicial electrónica que de una física, hoy se prefiere audiencias remotas; así es como Ecuador apuesta por la inclusión de los avances tecnológicos en aras de alcanzar una justicia que funcione al día, confiados en que por estos medios se den nuevas soluciones para viejos problemas. Tampoco existen sentencias o resoluciones que se hayan emitido consultando un asistente judicial virtual o sistemas similares que hagan uso de técnicas de inteligencia artificial, esta práctica en Ecuador no es convencional y aún genera resistencia. Contrario a lo que sucede en Ecuador, el mundo trabaja arduamente por desarrollar sistemas computacionales que sirvan de apoyo a las decisiones judiciales, poniendo una vez más la tecnología al servicio del derecho y de la justicia. Ya son reales los sistemas de asesoramiento legal, programas que interpretan los datos que han sido ingresados, analizan normas y precedentes y devuelven una explicación concreta y clara del asunto, ofreciendo como resultado una posible resolución en caso de que el conflicto llegue a una instancia judicial, es un tipo de sistema de predictibilidad; así, un usuario puede decidir si en función al posible resultado es más conveniente una forma alternativa de solución del conflicto, acceder a la justicia ordinaria o incluso mantenerse al margen de un litigio. Uno de los objetivos principales de estos sistemas es descongestionar los juzgados, si ya como antecedente se tiene que la posibilidad de un resultado favorable es baja, así gana el Estado y también el recurrente porque no gasta recursos innecesariamente. Hoy, es posible que este tipo de programas puedan asistir también al juez en la toma de decisiones pues son capaces de valorar prueba aportada por las partes, circunstancias relacionadas al caso, jurisprudencia y doctrina para así sugerir una posible resolución, la inteligencia artificial incorporada a estos programas permite que sean capaces de considerar una gran cantidad de información en segundos y ofrecer un resultado, trabajo que a un ser humano le llevaría días. Existen también los sistemas Sentencing Guidelines logrados con técnicas de deep learning, estos programas informáticos no solo imitan el razonamiento humano de un experto y como apoyo a la toma de decisiones pretenden uniformidad en los fallos sino que van más allá, alcanzan un análisis más profundo del perfil del infractor y evalúan diferentes variables para determinar la posibilidad de que el infractor pueda reincidir en conductas delictivas en un futuro, sugiriendo la pena a imponerse con atenuantes o agravantes, consecuencia de haber considerado todos estos factores, como una especie de justicia preventiva.

Si las ventajas de la tecnología son numerosas, lo son también las limitaciones de su aplicación. Evidentemente la legislación no esclarece en qué magnitud estas se manifiestan ni ofrece respuestas al respecto. No existe claridad ante los nuevos escenarios generados por la tecnología, porque la respuesta es simple: no es ni clara, ni uniforme, ni explícita. No se puede asegurar que para encontrar respuestas aceptadas y definitivas se tiene que se debe remitir a la normativa, cuando ni siquiera países con normas flexibles que en cierta medida se adaptan a las nuevas situaciones, han podido seguirle el paso al sin número de nuevos eventos como consecuencia de esta revolución tecnológica. Se piensa entonces que, menos podrán países como Ecuador que tienen sistemas legales rígidos.

La mencionada brecha entre la tecnología y la legislación ha existido, existe y existirá, ya de este contexto se deriva un gran inconveniente, téngase en cuenta por puntualizar una situación, que el uso de estas herramientas requiere de forma incuestionable que se alimenten máquinas con una gran cantidad de datos personales. Surgen inquietudes porque se está consciente de que estas plataformas pueden ser manipuladas, y se usan sin ni siquiera tener una ley de protección de datos personales. Preocupa la seguridad, preocupa que estos vacíos normativos puedan obstaculizar la digitalización de la justicia tal como se espera. Por esta y muchas otras necesidades se requiere al menos una adaptación de las normas que regulan la protección de datos personales, la administración de justicia y el proceso judicial. Además, un reto importante es la asignación de recursos económicos suficientes para la adquisición de los equipos y software que permitan la realización de todas las diligencias electrónicas de forma segura. Es evidente que al menos en una primera etapa, como la que atraviesa Ecuador, el costo es bastante alto, se requiere suficiente capacidad de los servidores para almacenar cantidades inmensas de información, plataformas web y móviles bien logradas, eficientes, seguras y amigables con el usuario, un equipo de soporte técnico constante, entre otros elementos.

Por ahora, los recursos digitales que se han adquirido y asignado para este fin aún son escasos. No se puede negar que en Ecuador el acceso a la tecnología difiere entre regiones, entre grupos económicos, sociales e incluso culturales. El reto es grande, porque esta brecha digital no solo problematiza, sino que impedirá el progreso. En tal virtud, necesariamente, ha de encontrarse la manera de garantizar el acceso a la justicia frente a la implementación de tecnologías en igualdad de condiciones.

Ahora bien, cuando lo nuevo reemplaza a lo viejo, se dan cambios sistemáticos profundos en la sociedad, y como bien se recordará, en el acontecer de la humanidad han sucedido otras grandes transformaciones que por supuesto generaron inquietud, incertidumbre y por tanto resistencia al cambio, tal como sucede hoy en día. Sin lugar a duda, asimilar la amplitud, la profundidad y la velocidad de esta nueva revolución, no es tarea fácil; hacerlo implica perder lo conocido, salir de la zona de confort y desarrollar nuevas destrezas y habilidades que permitan la adecuada adaptación al mundo tecnológico. Hay que trabajar en una nueva cultura, porque la adquisición de herramientas tecnológicas no basta por sí sola, para alcanzar el cambio que se desea. Ante esto, hay que aclarar que no solo funcionarios de la justicia están llamados a ser capacitados y a manejar estas herramientas a la perfección promoviendo el uso de los medios digitales en los juzgados como actores principales de esta transformación, sino sobre todo los abogados en libre ejercicio profesional que acudirán a la justicia, pues si no se logra una generalización del uso de estas herramientas entre ellos, si no aprenden a utilizarlas o si simplemente prefieren no usar los servicios digitales que se ponen a su disposición, entonces de poco o de nada servirá todo este esfuerzo, las cortes seguirán congestionadas, los usuarios seguirán insatisfechos, y en definitiva, no se habrán dado soluciones sino que incluso se habrán creado más diferencias como una suerte de desigualdad social creciente.

Finalmente, como país se reconoce que la tecnología no es el futuro sino que es el presente, que se avanza hacia el día en el que las máquinas serán capaces incluso de crear su propio pensamiento, en el que las técnicas de inteligencia artificial y automatización se convertirán en pieza clave para la dinamización y modernización de la actividad judicial en el país, se está consciente de que en todo este proceso juega un papel primordial la ética, la protección de datos y principios procesales contenidos en el ordenamiento jurídico, se sabe que las nuevas tecnologías contribuyen a mejorar la calidad del servicio y la gestión interna de la administración de justicia. Asimismo, también se perciben las dificultades que se presentan, principalmente la falta de regulación en este campo, y los cuestionamientos que plantea su uso por una posible colisión de derechos, los debates éticos y morales que se han generado. Y a pesar de ello, se ha de concluir diciendo la decisión de asumir el reto, se admite la evolución y la innovación tecnológica, y es aceptada desde una visión positiva para aprovechar las potentes olas de las tecnologías exponenciales que traerán gigantescas oportunidades de crecimiento.

La integración de la IA necesita el acompañamiento de rigurosos controles de transparencia que garanticen la calidad de los datos, algoritmos y proceso intelectivos que permita conocer si los datos están contextualizados, teniendo en cuenta todas las circunstancias relacionadas y, por otra parte, si datos, algoritmos o procesos han podido verse afectados por algún error o inclinación de costado. Y en concreto si los algoritmos son equitativos cuando afecten a consumidores o usuarios de la sanidad. En efecto, para identificar problemas de seguridad, la existencia de sesgos, etc., es imprescindible la transparencia e inteligibilidad de los sistemas de IA y a la vez, la posibilidad de acceso y verificación de los mismos, ya que de otro modo pueden quedar ocultos y resultar indetectables tanto para sus creadores como para los usuarios, sin que fuese posible remediarlos. Los sistemas de IA se basan en una condición de partida que concierne, en primer lugar, a sus diseñadores y desarrolladores. En efecto, aunque pueda resultar extraño, los sistemas de IA en su proceso de aprendizaje pueden derivar en el manejo de unos códigos que sean incomprensibles, incluso, para sus propios creadores y que solamente entendibles para las propias máquinas (Vida Fernández, 2018). Por lo tanto, es imprescindible que los sistemas de IA sean siempre transparentes y comprensibles de modo que sea posible acceder en todo momento a sus procesos y descifrarlos, sin que puedan dejarse que los sistemas se conviertan en una caja negra que funcione al margen de toda supervisión, lo que conecta con la cuestión del principio del control humano.

Además del carácter transparente y comprensible del funcionamiento de los sistemas de IA, se plantea la necesidad de que sea posible el acceso y verificación de estos procesos para ejercer un control externo que permita velar por su adecuado funcionamiento. En este sentido, se propone la utilización de un sistema de normalización para la verificación, validación y control de los sistemas de IA, asentado en un amplio espectro de normas en materia de seguridad, transparencia, inteligibilidad, rendición de cuentas y valores éticos (Cárcar Benito, 2014). Asimismo, se propone el reconocimiento de un derecho de acceso y verificación de los sistemas de IA por parte de los usuarios para que estos ejerzan un mayor control de los procesos de toma de decisiones automatizados y basados en algoritmos.

Pero más allá de la imputación jurídica de la decisión, es importante detectar en qué medida el resultado final ha sido condicionado o facilitado por la IA, dado que sobre todo cuando se originan vulneraciones de derechos o intereses legítimos, o vulneraciones del ordenamiento jurídico) habrá que proceder, en su caso, a precisar la responsabilidad de cada uno de los intervinientes, expertos en datos, diseñadores, implementadores, evaluadores, etc. Se trata en primer lugar de corregir los errores advertidos, pero también de atribuir las correspondientes responsabilidades en su caso. En este sentido la transparencia es imprescindible de la rendición de cuentas, ya que permite averiguar quién ha diseñado, implantado, evaluado y auditado la IA para localizar las responsabilidades jurídicas correspondientes si se producen decisiones ilegales, erróneas o lesivas de derechos e intereses hoy en día, ni siquiera está garantizada su viabilidad (las condiciones necesarias para que sea un instrumento útil y con verdadero valor añadido). En otros términos, no se trata aquí de la noción económica, sino la jurídica. Esta juridificación de la noción económica plantea un reto para el derecho sanitario y la IA, que significa empleo y asignación racionales de los recursos. En consecuencia, el razonamiento jurídico en el ámbito sanitario debe combinar su propia lógica, valores y emociones individuales con la IA. Esto obliga al profesional a tomar una posición y comprometerse con ella. Para lograrlo, se hace indispensable la reflexión, y la investigación de formas de pensar alternativas que permitan depurar las ideas ofrecidas por la IA. Además, se requiere un esfuerzo intelectual, entre la racionalidad y la razonabilidad, ya que, sin estas, será difícil llegar a algún resultado adecuado.

La paulatina integración de mecanismos en línea y sistemas inteligentes impone que estos aprendan de las experiencias desarrolladas por los humanos, los profesionales sanitarios, de ahí que resulte necesario que se permita a los sistemas acceder a los datos de los procesos, generar preguntas y procesar las respuestas de los participantes en los procesos asistenciales. Cuando se renuncia a este esfuerzo, se termina actuando de manera pasiva y copiando propuestas que imposibilitan alcanzar la solución de los nuevos escenarios. La clave de todo ello es que la IA dentro del derecho sanitario debe ser entendida como una herramienta de apoyo, un complemento al trabajo del jurista.

Por otra parte, existe la necesidad de resolver con pactos interprofesionales previos a cualquier normativa reguladora, la cuestión de los ámbitos competenciales de las profesiones sanitarias. El mantenimiento de la voluntad de reconocer simultáneamente los crecientes espacios compartidos y los muy relevantes espacios específicos de la IA es hoy imperioso. No se debe pretender determinar las competencias de los profesionales y de la IA de una forma cerrada y concreta, sino que se deben establecer las bases para que se produzcan estos pactos, y que las praxis cotidianas evolucionen de forma no conflictiva, sino cooperativa y transparente. En realidad, abogo por un punto de encuentro del derecho sanitario y la IA, que sería una herramienta para la generación, análisis y divulgación de contenidos científicos y jurídicos, principalmente adaptada al contexto producido por esta crisis sanitaria y con el deseo de contribuir a la reconstrucción social, sanitaria y económica del sistema sanitario. La idea de razonabilidad, por tanto, debe abarcar la proporcionalidad, siendo ésta una consecuencia o manifestación de la asistencia sanitaria y las aplicaciones de la IA, mediante la cual se puede llegar a determinar si una actuación sanitaria es o no jurídicamente la más adecuada para perseguir un determinado fin (Sapag, 2008).

La mayoría de las aplicaciones clasificadas como inteligencia artificial son simplemente asistentes inteligentes que aumentan y sirven a los humanos, lo que hacen que cualquier persona pueda manipular estos sistemas fácilmente descifrando su algoritmo y llegar a causar robos, extorsiones, suplantación de identidad, trayendo riesgos para los humanos afectando el uso de datos personales. Así mismo, Debía (2019), señala como la IA es una simulación de procesos que se basa en un análisis de datos llamado Big Data, donde se encuentran los datos personales que se deben cumplir en los estándares éticos que son la responsabilidad y la protección de derechos. Por esa razón, el autor plantea que la IA no es lo suficiente para procesar datos personales ya que no suele utilizarlos correctamente. Por último, Zarabia (2018), explica los riesgos que causa la IA haciéndonos entender que fue un invento para provocar accidentes y abusos a las personas que utilizan estos sistemas para guardar sus datos personales. La disponibilidad de la Big Data y el uso de herramientas de IA son afectados por la integridad social, lo que indica que la privacidad y la protección de los datos personales pueden verse afectados de diferentes formas. Como cualquier sistema, la IA no es una excepción debido a que se ha verificado las vulnerabilidades de protección. Es posible que los usuarios no sepan que se están creando perfiles para ellos o que no comprendan su significado, es por ello que este análisis puede retener permanentemente los estereotipos y el aislamiento social existente. Los seres humanos no son capaces de navegar y analizar toda la documentación que se encuentra digitalizada, entonces lo que permite la IA es analizar toda esa información elaborada para llegar antes a las opciones que se plantean y poder elegir.

Desde la posición original -como la denomina Rawls- y bajo el velo de la ignorancia -nadie sabe en qué situación le colocará la vida-, se está en condiciones para definir los principios y normas exigibles en la construcción de esa sociedad justa. Dichas condiciones, según Rawls, son las siguientes: a) Principio de libertad: Toda persona tiene igual derecho a un régimen de libertades básicas compatible con un régimen similar para los demás; b) Principio de igualdad de oportunidades: las desigualdades sociales y económicas debe estar abiertas a todos en condiciones de igualdad de oportunidades) Principio de la diferencia: hay que procurar el máximo beneficio para los menos desfavorecidos por la lotería de la vida. Una evaluación de los costes, de las consecuencias, es imprescindible en el nuevo marco de la asistencia sanitaria, como consecuencia de la IA. ¿Acaso maximizar las consecuencias buenas y buscar el máximo beneficio para todos no es justo? Parece que la respuesta es afirmativa pues no se puede negar que la primera obligación del sistema público es el de dar y garantizar prestaciones eficaces y eficientes, en este caso, a través de la IA. El problema es la aplicación en sí, y las razones por las cuales en los sistemas inteligentes permiten alcanzar un alto grado de eficacia en la actividad de gestión y obtener mayor precisión y legitimidad en la fase decisoria cuando la decisión del juez o tribunal se vea corroborada con el resultado del propio sistema sanitario (Zúñiga Fajur, 2010).

Por lo tanto, es necesario desarrollar herramientas de control y verificación para establecer criterios y mejores prácticas. Sólo así podremos beneficiarnos de todo el potencial de la inteligencia artificial y, al mismo tiempo, evitar los numerosos riesgos que sin duda plantea. Según Fernández García, la inteligencia artificial tendrá un impacto más que significativo en la gestión de los recursos humanos y los riesgos de los trabajadores. En este sentido, basta con observar la intermediación laboral digital, especialmente en los procesos de formación profesional, organización de actividades productivas, etc. El autor defiende el potencial de la inteligencia artificial, aunque, en realidad, no escatima esfuerzos para poner de manifiesto los riesgos para el empleo y el mercado laboral, así como para ciertos derechos fundamentales. La envergadura de los retos expuestos permite vislumbrar sin dificultad la importancia del derecho laboral y de la seguridad social en la futura e inevitable reformulación de la arquitectura de la protección social. Pero lo cierto es que las objeciones no son pocas: aspectos relacionados con la privacidad, la parcialidad, la falta de transparencia, etc. Hay incluso un grado de intimidación en cuanto a las objeciones. Se recomienda, en la medida de lo posible, arrojar luz sobre cómo los algoritmos pueden, en su caso, contribuir a la prevención y el control de la delincuencia, con el fin de desarrollar herramientas que puedan optimizar con seguridad las capacidades de la inteligencia artificial y, por tanto, aplicarse en la ley.

La propiedad intelectual está llamada a desarrollar al respecto, un papel más que relevante. Por la propia evolución de los hechos, algunos conceptos cuya protección recae sobre la propiedad intelectual, acabarán por ser redefinidos por la inteligencia artificial. El reajuste resulta, a todas luces, imprescindible. Es cierto que durante más de tres décadas los avances en la tecnología de la información y la comunicación (TIC) irrumpieron en los procedimientos de los tribunales prometiendo transparencia, eficiencia y cambios radicales en las modalidades de trabajo.

Por mencionar algunos aspectos positivos, con la introducción de las TIC en la rama del derecho se podría apostar por la economía procesal, la celeridad, mayor seguridad en la valoración de las pruebas -siempre que sea posible- y mejor acceso a la justicia para la población en general, de escasos recursos y personas con movilidad limitada. También se podrá advertir, aunque en una fase avanzada, reducción de costos para el Estado y para las partes, acceso a la justicia, desde cualquier parte del mundo, e incluso apertura a los litigios transfronterizos. Por otro lado, los profesionales de la justicia podrán ahorrar tiempo y optimizar su trabajo, tendrán alcance inmediato a la información y se evidenciará mayor confianza en la administración de justicia. Estas enunciaciones ventajosas son aún más importantes en la medida en la que permitirán una disminución de las tareas repetitivas que realizan los especialistas del derecho; así, jueces y otros auxiliares de la justicia podrán dedicarse a la tarea para la cual fueron asignados a ese puesto: estudiar los casos, tomar decisiones y poner fin a las controversias que conozcan. En definitiva, las TIC abren puertas que permitirán cumplir, en mayor medida, las garantías, los derechos fundamentales y los principios procesales establecidos en la norma.

Anteriormente las empresas no conocían la importancia de la inteligencia artificial como medio de comunicación en vez de personas, la mayoría creía que no era útil porque no estaba el factor humano que caracteriza la atención al cliente, pero según las metodologías de desarrollo que plantean de manera anual y las auditorías de empresas consultoras encargadas de optimizar y mejorar el rendimiento de la empresa en muchos sectores, se ha visto un incremento en las empresas que han implementado la inteligencia artificial como medio de comunicación para los clientes.

Aplicación del método: PESTEL al caso de estudio presentado (Tabla 1).

Tabla 1 - Análisis PESTEL.

| Dimensión | Factor | Estado |

|---|---|---|

| Político | Política de financiación para la aplicación de la IA al derecho |

Políticas inflexibles ante la virtualización integral de los procesos judiciales por considerarse esta práctica como no convencional generando resistencia. Bajo nivel de control de las autoridades competentes, al facilitar los procesos de contratación pública en el estado. Los países más adelantados en la aplicación de la IA al derecho, no han podido seguirle el paso al sin número de nuevos eventos como consecuencia de esta revolución tecnológica. |

| Económica | Insuficiente presupuesto económico y financiero para afrontar los cambios necesarios |

Restructuración de infraestructuras técnicas y organizativas a nivel nacional para adaptarse al uso de las nuevas tecnologías. Asignación de recursos económicos suficientes para la adquisición de los equipos y software necesarios que permitan la realización de todas las diligencias electrónicas de forma segura. No existen las mínimas condiciones para implementar estas nuevas herramientas asociadas a la inteligencia artificial. Su implementación se hará por fase y no de forma integrada. |

| Sociales | Resistencia al cambio y a lo desconocido. |

Impacto en la sociedad y se habrán creado más diferencias como consecuencia de la desigualdad social creciente. Evaluar las habilidades de la toma de decisiones de un experto humano en el campo del derecho utilizando la inteligencia artificial. Los recursos digitales que se han adquirido y asignados para este fin aún son insuficientes y escasos. Posible violación de los derechos humanos con el uso indebido de los datos personales o la desprotección de los mismos. |

| Tecnológicas | Afectaciones en las infraestructuras tecnológicas |

En Ecuador el acceso a la tecnología difiere entre regiones, entre grupos económicos, sociales e incluso culturales. Esta brecha digital no solo problematiza, sino que impedirá el progreso. Salir de la zona de confort y desarrollar nuevas destrezas y habilidades que permitan la adecuada adaptación al mundo tecnológico. No existe cabida aún para otros usos posibles relacionados a sistemas con técnicas de inteligencia artificial que establezcan una interconexión eficiente de información. |

| Ecológicas | Afectaciones al medio ambiente |

Posibles afectaciones al entorno por consumo de energía, entre otros factores. No se reconocen objetivamente posibles afectaciones al medio ambiente. No existe claridad ante los nuevos escenarios generados por la nueva tecnología y sus consecuencias al respecto. |

| Legales | Violación de normativas y regulaciones |

Falta de una legislación que aclare o regule el uso y aplicación de la inteligencia artificial. No se ha alcanzado la operatividad deseada entre las bases de datos y verificación de la información para mitigar los riesgos. Ecuador presenta sistemas legales rígidos. Alimentamos máquinas con una gran cantidad de datos personales y los usamos sin ni siquiera tener una ley de protección de datos personales. |

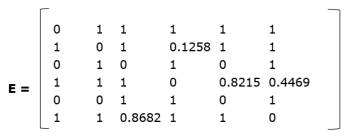

Aplicación de la técnica Mapa Cognitivo Difuso al diagnóstico presentado mediante PESTEL

El mapa cognitivo difuso y la matriz de adyacencia resultantes de la interrelación entre las características señaladas son los siguientes (tabla 2) (Fig. 2):

Tabla 2 - Análisis estático del mapa (od, id, td) y clasificación de las variables (nodos).

| Variables | od | id | td | |

|---|---|---|---|---|

| 1 | Política de financiación para la aplicación de la IA al derecho | 5.00000 | 5 | 10.00000 |

| 2 | Insuficiente presupuesto económico y financiero para afrontar los cambios necesarios | 4.12580 | 5 | 9.12580 |

| 3 | Resistencia al cambio y a lo desconocido. | 3.00000 | 4.8682 | 7.86820 |

| 4 | Afectaciones en las infraestructuras tecnológicas | 4.26840 | 4.1258 | 8.39420 |

| 5 | Afectaciones al medio ambiente | 3.00000 | 4.8215 | 7.82150 |

| 6 | Violación de normativas y regulaciones | 4.86820 | 4.4469 | 9.31510 |

Todos los nodos (causas) son ordinarios por lo que todos mantienen una relación entre sí. De forma que no se puede analizar un problema por separado. A pesar de ello, se pueden establecer estrategias acordes a su orden jerárquico. Las cuales estarán relacionadas entre sí por el carácter ordinario de las causas que las originaron.

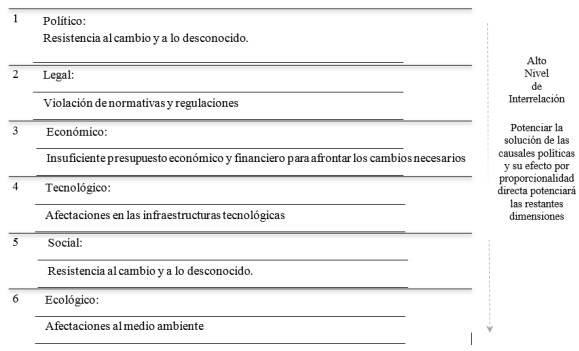

Se puede decir que son causa y consecuencia con una relación causal directamente proporcional, aunque en diferentes magnitudes. Las cuales se manifiestan en la mayoría de los casos de forma bidireccional. Por lo que para la propuesta de soluciones se contempla el efecto dominó que se pudiera experimentar. De esta forma se podrán minimizar los recursos a destinar para la mejora de la situación analizada (Fig.3).

La aplicación de la inteligencia artificial se ve afectada con riesgos de garantizar la seguridad, confidencialidad, la libertad, la integridad y la dignidad de sus clientes, es decir, es una trascendencia humana inventada donde puede provocar accidentes y abusos en su uso y poder de toma de decisiones con el desarrollo de la internet y el consentimiento de los datos mediante su aplicación. Es por ello que tener presente y ser conscientes de la importancia de establecer nuevas normativas y regulaciones que garanticen el desarrollo, desempeño y logro de los resultados esperados con esta nueva aplicación de la IA, son premisas para este proceso. Así como disponer de un respaldo económico que garantice la infraestructura tecnológica necesaria para conformar todo el proceso y con ello los cambios necesarios.

De igual forma se deben establecer campañas de capacitación para evitar la resistencia al cambio y promover así el uso de las tecnologías a disposición de los profesionales y estudiantes del derecho.

Conclusiones

El mundo trabaja arduamente por desarrollar sistemas computacionales que sirvan de apoyo a las decisiones judiciales, poniendo una vez más la tecnología al servicio del derecho y de la justicia.

Existe un incremento en las empresas que han implementado la inteligencia artificial como medio de comunicación para los clientes.

La importancia de la IA como implementación para los servicios de atención al cliente, se puede decir según las encuestas realizadas y los datos obtenidos que los chatbots, serán un beneficio tanto económico como útil para las compañías, además que permitirán generar más desarrollo en diferentes sectores y automatizar procesos que anteriormente eran de mayor duración.

La llegada de la IA ha supuesto una nueva revolución que podría llegar a ser una de las más grandes vividas hasta el momento, ofreciendo mayores comodidades a todo aquello que rodea a las personas en la actualidad.

Mediante la investigación realizada sobre las limitaciones, funcionalidad y beneficios de la inteligencia artificial en la optimización de procesos aplicados al derecho, se ha podido destacar que, si bien brindan una mejoría en los tiempos de respuesta y una orientación adecuada para el usuario, es necesario tener en cuenta que esta herramienta no para todos los usuarios es de gran comodidad y se requiere poder modificar la interacción de la IA con cada usuario, siendo necesario tener en cuenta la opinión de sus clientes para el correcto funcionamiento de esta herramienta.

Es necesario que se tengan en cuenta las necesidades de los usuarios, buscando no solo la optimización de los procesos solicitados, sino también la mayor comodidad de interacción y apoyo de los usuarios hacia esta herramienta. Estos procesos son fundamentales para aumentar la eficacia de todos los sistemas tecnológicos, haciendo frente a los errores técnicos y/o humanos, automatizando y agilizando la información que se desempeña en el hardware, con frecuencia el rendimiento se reduce dependiendo de conexiones ineficientes o debido a sobrecargas del sistema en procesos.

Este sistema de optimización de proceso con IA ayuda a determinar cuáles son las actividades que incrementan las posibilidades de éxito, mejorando el proceso de software encargado del desarrollo y ejecución del sistema.

Se puede llegar a manifestar un alto bienestar del servicio al cliente, donde mediante la lectura de rasgos y de información captada, se podrá mantener una conversación estable con los clientes, logrando un extremo cuidado de interacción y seguimiento de indicaciones, mostrando también el caso de un nuevo apoyo para las empresas en distintas áreas de trabajo para una optimización empresarial.

Así que la IA está entrando en el mundo del derecho para ofrecer nuevas oportunidades. Aunque algunas actividades realizadas por los abogados perderán importancia, los estudiantes deberán prepararse para tareas más centradas en el análisis y la conceptualización de todo lo que pasa por las manos de la IA.