Introducción

En vista de la importancia que han tomado las redes de datos en las distintas organizaciones como empresas, universidades, etc. Todas buscan tener la mayor seguridad en su arquitectura de red para evitar pérdidas económicas, así como evitar poner en riesgo los pilares de seguridad informática (Poljak, Ševo & Livaja, 2016). En vista que la información representa el factor primordial por el cual muchos usuarios malintencionados cometen actos ilícitos, con herramientas y técnicas que requieren muy poco nivel técnico, logrando en la mayor cantidad de casos comprometer la seguridad de las comunicaciones. En ese entender, se hace posible disminuir el nivel de riesgo de forma significativa y con ello la materialización de las amenazas y la reducción del impacto sin necesidad de realizar elevadas inversiones ni contar con una gran estructura de personal, para ello, se hace necesario conocer y gestionar de manera ordenada los riesgos a los que está sometido el sistema informático, considerando procedimientos adecuados y planificando e implantando los controles de seguridad que correspondan (Maheshwari, Krishna & Brahma, 2014). Así también, resulta importante llevar un registro histórico del tráfico generado para poder revisarlo cada vez que un fallo de seguridad desconocido se hace público, para de esta manera, poder medir el impacto de dicho fallo en la organización. En esa intención, se tiene como objetivo servir como medio de consulta para apoyar la implementación de nuevos sistemas de seguridad (Al-Dalky, Salah, Al-Qutayri & Otrok, 2014).

Objetivos del estudio

Detección temprana de ataques nuevos en la red para poder optar por medidas correctivas.

Encontrar las vulnerabilidades que tienen las organizaciones en sus sistemas de comunicaciones.

Control de acceso a servicios restringidos mediante políticas de seguridad.

Identificar el impacto operacional por fallas en los sistemas de información y comunicaciones de una organización.

Relacionar las diferentes formas de prevención a los diversos ataques a las infraestructuras de red.

Control de tráfico por parte del personal para evaluación del desempeño.

La importancia de los objetivos mencionados tiene que ver con brindar a la organización total transparencia en las comunicaciones, para poder tomar medidas ante acontecimientos que puedan poner en riesgo la organización, así como preservar los pilares de la seguridad informática que, según Amran & Saad (2014), son:

Confidencialidad: Se refiere a la protección de datos frente a la difusión no autorizada.

Disponibilidad: Se refiere a la continuidad operativa de la entidad, la perdida de disponibilidad puede implicar, la pérdida de productividad.

Integridad: Es necesario asegurar que los datos no sufran cambios no autorizados.

Estado del arte

En Han, Kwon, Hahn, Koo & Jur (2016), se describe un Man-in-the middle (MITM) que permite a un atacante supervisar el intercambio de comunicación entre dos partes, dirigiendo el tráfico entre ellos, para pasar por la máquina del atacante. La mayoría de los sistemas existentes que descubren el MITM se centran en detectar los mecanismos que utilizan los atacantes para dirigir el tráfico a sus dispositivos. En este trabajo se presenta un nuevo esquema de detección que se basa en la coincidencia de la carga útil de las tramas intercambiadas en la red. El esquema propuesto es independiente del mecanismo utilizado para lanzar el ataque MITM. El resultado experimental muestra que el esquema propuesto puede alcanzar un excelente rendimiento de detección con la elección adecuada de los parámetros de ajuste del régimen. Según Husák, Čermák, Jirsík & Čeleda (2015); y Al-dalky, Salah, Al-qutayri & Otrok (2014), explican como un ataque MITM (man-in-the-middle) se hace generalmente por spoofing entre la red de punto de acceso y los clientes. En este trabajo, se propone un algoritmo, SAL-HASH, para detectar ataques MITM sin necesidad de certificaciones (Atanasovski & León-García, 2015). En este artículo se estudia que en la simulación de IP, las direcciones IP se pueden falsificar fácilmente, por lo tanto, hace que sea difícil para filtrar los paquetes legítimos de los falsificados, en Chakraborty, Chaki & Cortesi (2014) se presenta un sistema de correlación de alertas para mitigar el problema de los falsos positivos en los sistemas de detección de intrusos, cuando se aplican técnicas de detección de anomalías. El sistema permite la evaluación cuantitativa de la probabilidad de que una alerta emitida a causa de una anomalía se convierte en una amenaza real (Lee & Yun, 2015).

Materiales y métodos

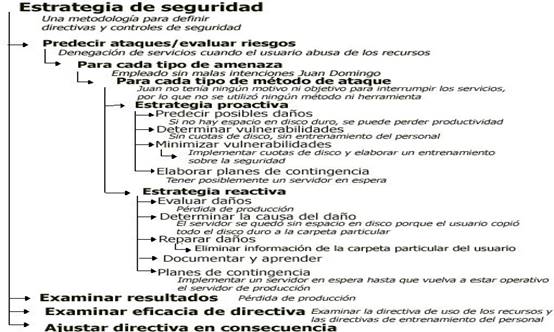

La metodología de seguridad informática, según Benson (2001), específicamente, fue diseñada para apoyar a quienes trabajan con el desarrollo de la seguridad, las estrategias y planes para la protección de la disponibilidad, integridad y confidencialidad de los datos de los sistemas informáticos. Como se puede ver en una descripción definida en la figura 1.

Existen cuatro pasos a seguir dentro de esta metodología.

Identificar métodos, herramientas y técnicas de ataques probables: Métodos, herramientas y técnicas de ataques que pueden abarcar, desde algo como los diversos virus existentes hasta las nuevas metodologías de implantación codificada de sistemas que alteran e infringen contra la integridad y estabilidad de los datos.

Establecer estrategias pro-activas y reactivas: Nos encamina a reducir al mínimo las directivas de seguridad así como de desarrollar planes de contingencia.

Pruebas: Se debe llevar a cabo luego de que se haya puesto en marcha las estrategias pro-activas y reactivas, con el fin de mejorar las directivas y controles de seguridad a implementar posteriormente.

Formar equipos de respuestas a incidentes: Se identifican herramientas de software para responder a incidentes, realización de actividades formativas, junto con la ejecución de estudios a ataques al sistema. (Figura 1)

En conjunto, con esta metodología se tomó en cuenta para la implementación de SGSI (Sistema de Gestión de Seguridad de Información), como se aprecia en la figura 2 y se detalla en la tabla 1:

Tabla 1 Modelo PHVA SGSI.

| Planificar | Establecer las políticas, los objetivos, procesos y procedimientos de seguridad necesarios para gestionar el riesgo y mejorar la seguridad informática, con el fin de entregar resultados acordes con las políticas y objetivos globales de la organización. |

| Hacer | Tiene como objetivo fundamental garantizar una adecuada implementación de los controles seleccionados y la correcta aplicación de los mismos |

| Verificar | Evaluar y, en donde sea aplicable, verificar el desempeño de los procesos contra la política y los objetivos de seguridad y la experiencia práctica, y reportar los resultados a la dirección, para su revisión |

| Actuar | Emprender acciones correctivas y preventivas basadas en los resultados de la verificación y la revisión por la dirección, para lograr la mejora continua del SGSI. |

Resultados

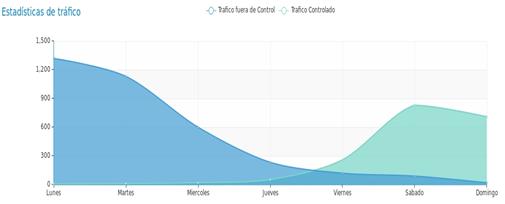

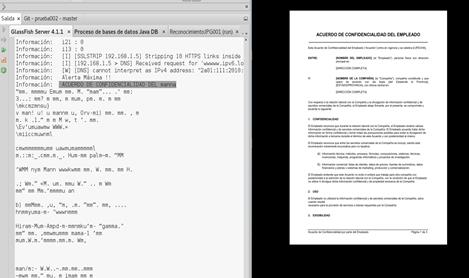

En los resultados obtenidos, como se observa en la figura 3, se define que el guardar los registros de tráfico generado en la red de datos con un gran detalle, facilita la inspección de los mismos para el análisis de posteriores eventualidades en casos específicos, donde se necesite realizar una auditoría de una conexión en concreto.

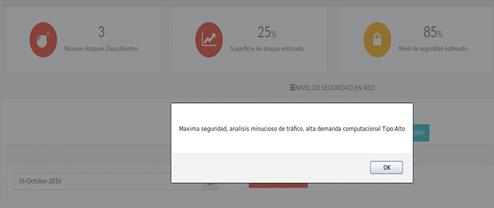

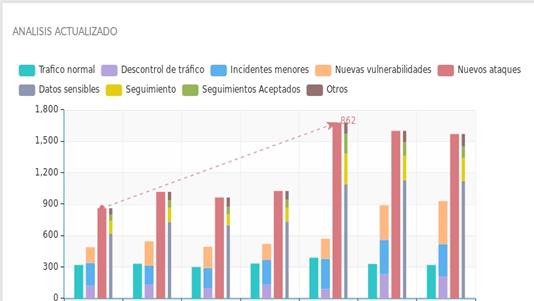

En la figura 4, se observa el despliegue de un dashboard en un navegador web, con el objetivo de facilitar la tarea, tanto del análisis de seguridad como el de estadísticas del tráfico interno, siendo objetivo también el análisis de los ciber-ataques realizados en determinado periodo de tiempo, el dashboard permite apreciar un panorama general de tráfico generado y alertas de seguridad para entrar en detalle en cada uno de ellos.

Como se aprecia en la figura 5 de seleccionar el modo de seguridad más alto el sistema consumirá más recursos computacionales ya que internamente se evaluarán conexiones de dudosa procedencia, como se observa en la figura 6 se procede a eliminar el excesivo tráfico fuera de control que podría ser categorizado como un ataque DOS/DDOS, el IDS entra en una configuración en la que almacenará todas las imágenes que se quieran transmitir por la red de datos y analizará cada una extrayendo en texto que estas contengan, en la figura 7 se observa el paso de una imagen, la cual al ser analizada se detecta que el texto contiene la palabra “confidencial”, por lo cual se tomará acción según las normas establecidas pudiendo ser estas la de eliminar la conexión, realizar seguimiento de la conexión o disparar cierto tipo de alertas a las personas encargadas.

Los gráficos de barras son una herramienta muy útil al momento de analizar el tráfico realizados por los empleados de la organización, podemos inspeccionar la actividad en las redes internas para luego obtener problemas de desempeño o Incidentes en la red. En la figura 8, se observa entre otros, las alertas de nuevos ataques tras pasar el tráfico histórico por el sistema de detección de intrusos luego de actualizar las firmas de seguridad con ataques recién descubiertos, esto da una perspectiva de cuanto impacto tuvieron estos ataques sobre la organización.

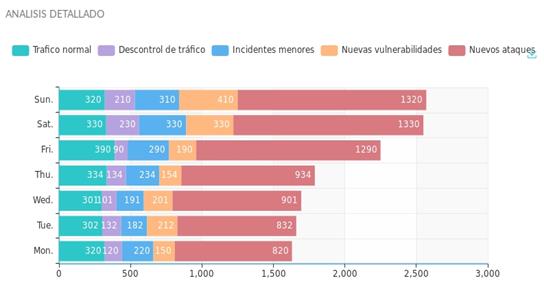

En la figura 9, se aprecia un cuadro de barras detallado con el número de conexiones especificas entre las clasificadas, se puede observar el tráfico normal, descontrol de tráfico, incidentes clasificados como menos, nuevas vulnerabilidades a controlar y nuevos ataques dentro de la organización.

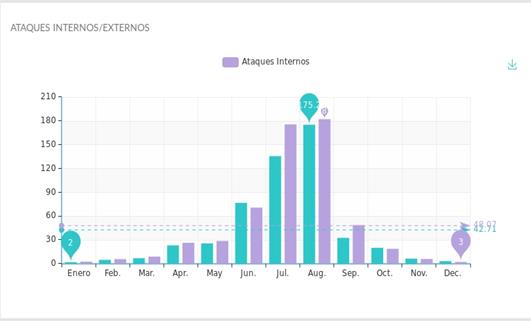

En la figura 10 se aprecia un gráfico de barras sobre los ataques realizados tanto de manera interna como de manera externa.

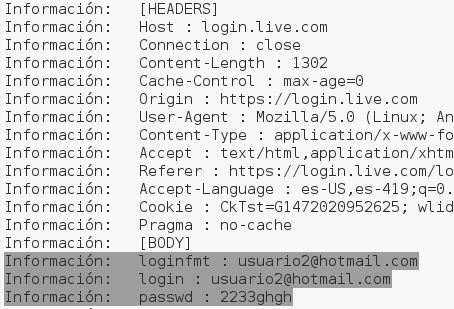

Podemos observar una cuestión particular al realizar la monitorización de tráfico, cualquier servicio al que se acceda que no cuente con una implementación de conexión segura, es decir, certificados de seguridad (SSL), podrá ser inspeccionada poniendo en riesgo información sensible, tales como credenciales de seguridad, también existen distintas técnicas capaces de burlar el protocolo de seguridad HTTPS o HSTS (Figura 11), como se explica en Selvi (2014).

Discusión

El presente estudio muestra las medidas de seguridad a tomar en contra de muchos de los incidentes que ocurren en las redes de datos, comúnmente suelen pasar inadvertidos, ya que técnicas de evasión de seguridad, tales como Spoofing, en Urueña (2015) o Rogue AP based MitM en Zhang (2014), son cada vez más sofisticadas y requieren de un menor nivel técnico. Este estudio presenta que aunque la organización sea atacada con técnicas nuevas que no son reconocidas por los sistemas de seguridad, al contar con todo el tráfico de la red almacenado, se podrá analizar comportamientos sospechosos, los cuales se mantendrán en cuarentena hasta tomar las medidas de seguridad respectiva (Vidal, Orozco, Villalba & Member, 2015).

Conclusiones

Tener una métrica sobre los ataques, así como el impacto de éstos, mantiene nuestra matriz de riesgos actualizada.

La detección temprana de ataques logra mitigar en gran medida un fallo de seguridad, si la organización no se encuentra pendiente.

Auditar las redes constantemente disminuye en gran medida la superficie de ataque.

Al contar con una detección temprana de intrusos y evaluar el tráfico interno permite evaluar una seguridad perimetral a más detalle, así como tomar medidas para controlar los lugares a los que se tiene acceso por medio de la red de datos, haciendo cumplir de esta manera nuestras políticas de seguridad y salvaguardando los pilares por los que vela la seguridad informática (CIA).

Facilitar el establecimiento de políticas de seguridad hace que los usuarios inspeccionen más detalladamente los eventos de la red.

El control de tráfico es vital para obtener pistas de auditoría en cualquier momento.