Detección de regiones salientes en imágenes en el espacio de los quaternions

Saliency detection in images in the quaternion space

Reynolds León Guerra1*, Edel B. García Reyes2

1Centro de Aplicaciones de Tecnologías de Avanzada (CENATAV), La Habana, Cuba.

]]>

RESUMEN

En el presente trabajo es desarrollado un algoritmo para detectar las regiones salientes en las imágenes en el espacio de los quaternions. Para obtener mapas de regiones salientes, una pirámide Gaussiana es creada para procesar imágenes a diferentes escalas mediante dos enfoques (local y global) conservando los objetos predominantes. Las imágenes son representadas en el espacio de los quaternions donde se conserva la relación entre los espacios de color RGB y HSV utilizando rasgos. En el enfoque local (dominio espacial), las imágenes son divididas en parches para la comparación entre el módulo y la fase del quaternion y es desarrollada una variante nueva del descriptor Quaternion Local Binary Patterns. En el enfoque global, las imágenes son procesadas en el espacio de la frecuencia de Fourier para quaternions, donde el espectro del módulo es transformado mediante un filtro pasa baja y es reconstruida la información para obtener un mapa global. El mapa final de regiones salientes es logrado mediante una combinación ponderada de los mapas locales y el global, para después aplicar una función de center bia y un refinamiento al mapa final. Para comprobar la eficacia del algoritmo propuesto es validado mediante la métrica error medio absoluto en la base de datos ECSSD-1000 y comparado con otros algoritmos del estado del arte.

Palabras clave: combinación, quaternions, regiones salientes

ABSTRACT

In this paper, we developed an algorithm that allows the saliency detection in images in the quaternion space. To obtain maps of saliency, a Gaussian pyramid is built to process images at different scales through two approaches (local and global) while conserving salient objects. Images are represented in the quaternion space where the relationship between RGB and HSV color spaces is conserved using feature. In the local approach (spatial domain), the images are divided into patches for the comparison between the module and the phase of quaternion and a new variant of Quaternion Local Binary Patterns descriptor is developed. In the global approach, the images are processed in the quaternion Fourier frequency space, where the module spectrum is transformed by a low pass filter and the information is reconstructed to obtain a global map. The final map of saliency is achieved by a weighted combination of local and global maps and after applying a function of center bia more a refinement in the final map. To verify the effectiveness of our proposed algorithm it is validated using the mean absolute error metric in the ECSSD-1000 data set and compared with other state of the art algorithms.

Key words: combination, quaternions, saliency regions

La detección de regiones salientes (RS) en las imágenes permite obtener un mapa topográfico donde cada punto es la probabilidad de ser observado por una persona (ver Figura 2, c-f ). Lo antes mencionado es fundamentado en el criterio que el cerebro humano tiene la capacidad de eliminar la información redundante y solo procesar la de interés (Aytekin et al., 2016). La emulación de esto permite realizar tareas de forma automatizadas como: segmentación de imágenes (Li et al., 2014), detección de objetos (Xia et al., 2017), etc. Por lo antes explicado, en los últimos años ha tenido una creciente atención por la comunidad de visión por computadora la tarea de detección de RS. Existen por lo general dos enfoques principales orientados a obtener las regiones salientes, bottom up y top down, el primero se basa en buscar los rasgos menos frecuentes en una imagen y el segundo está basado en tareas u objetivos. En el presente trabajo se toma como enfoque a seguir buttom up, por su baja complejidad computacional.

Diferentes autores han abordado el enfoque bottom up como sigue: (Erdem and Erdem, 2013), aplican el descriptor (region covariance descriptors) para rasgos basados en color, orientación e información espacial para comparar la similitud que hay entre diferentes parches en la imagen y poder obtener las regiones salien- tes. (Hu et al., 2015), combina la extracción de rasgos locales con rasgos globales en un mapa final donde se ponderan los píxeles a partir de su distancia al centro de la imagen. (Liu and Hu, 2016), realizan una com- binación de mapas obtenidos en el dominio de la frecuencia de Fourier para quaternions para buscar el más óptimo. (Yu et al., 2015), utilizan el contraste global de colores para determinar el mapa de la región saliente agrupando los pixeles del fondo de la imagen considerando que son similares. (Wang et al., 2015) emplean un aprendizaje basado en redes neuronales profundas para aprender rasgos locales y globales y el mapa final es una combinación de los dos mapas obtenidos en las redes entrenadas. (Rajankar and Kolekar, 2015), aplica una reducción de la escala por interpolación a los coeficientes de Fourier para quaternions obteniendo el mapa optimo mediante la inversa de Fourier.

Los trabajos antes citados no tienen presente la correlación que existe entre los diferentes rasgos y espacios de colores usados para obtener los mapas de regiones salientes. Por lo que la detección de RS en general no detecta todas las partes de los objetos salientes. Para resolver el problema, en el algoritmo propuesto se obtienen los mapas mediante una combinación de rasgos que representan a los espacios de colores RGB (Red, Green, Blue) y HSV (Hue, Saturation, Value) mediante los quaternions. Además los mapas se obtienen mediante un enfoque local y global para combinar ambos obteniendo un mapa final de regiones salientes.

Los aportes principales del trabajo son los siguientes: Primero, las imágenes son representadas en el espacio de los quaternions como una combinación de los espacios de color RGB y HSV. Segundo, se aplica un enfoque local donde es desarrollada una variante nueva del descriptor Quaternion Local Binary Patterns para el módulo del quaternion. Tercero, el mapa global es obtenido mediante la transformada de Fourier para quaternions modificando el módulo espectral y reconstruyendo un nuevo quaternion mediante la inversa de Fourier.

MATERIALES Y MÉTODOS

Enfoque propuesto

El enfoque propuesto para la determinación de las RS en las imágenes está compuesto de los siguientes pasos: Primero, se aplica una pirámide Gaussiana de reducción a la imagen de entrada para obtener 4 niveles más la imagen base ( los objetos salientes por lo general son invariantes a diferentes escalas). Segundo, las imágenes son representadas mediante full-quaternions para conservar la correlación entre los espacios de color RGB, HSV y el contraste (claro - oscuro). Tercero, en cada imagen es determinado dos mapas local y uno global en el dominio espacial y de frecuencia respectivamente. Cuarto, una combinación ponderada es aplicada para obtener un mapa previo final para aplicar una función de center bia y de refinamiento que permita obtener el mapa de RS final.

Pirámide Gaussiana

]]> Los objetos salientes en una imagen por lo general son invariantes a las trasformaciones de escalas conservándose los mismos. Con el objetivo de obtener múltiples mapas de RS, a la imagen original se le aplica un proceso de multi-resolución mediante una pirámide Gaussiana de reducción con el algoritmo de (Burt and Adelson, 1983) para obtener 4 niveles de representación y la imagen base. Sin embargo, debido a que las imágenes originales tienen diferentes tamaños es necesario normalizar la misma a un tamaño estándar por cada nivel que facilite el procesamiento en otros pasos del algoritmo propuesto. Es evidente que la información en las imágenes normalizadas es dependiente de las imágenes a cada nivel (ver Figura 1).Representación de la imagen mediante quaternions

El quaternion es una extensión de los números complejos propuesto por Hamilton en 1843 (Morais et al., 2014) y es denotado por la letra H. Si q∈H, puede representarse como:

{q = t + xi + yj + zk|(t, x, y, z) ∈ R} (1)

Donde los operadores complejos i.j, k cumplen con las siguientes reglas { i2 = j2 = k2 = ijk = -1, ij = k = -ji,ki = j = -ik, jk =i = -kj}. Estas reglas muestran que Ia multiplicaci6n de los quaternions es no conmutativa. Otra forma de representar a!quaternion es:

q= Sq+Vq (2)

Donde (Sq = t) denota la parte real y (V q = :ti + yj +zk) denota la parte imaginaria o vector. Si Sq = 0, el quaternion es nombrado pure quaternion, si Sq ≠ 0 es nombrado full-quaternion.

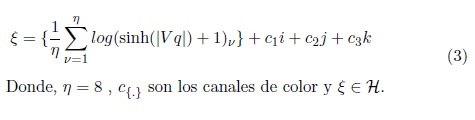

Todas las imagenes son procesadas en los espacioo de color R.GB y HSV para obtener la parte real del qua ternion. La parte real representa el rasgo de tipo contraste claro oscuro que existe en la imagen a apartir de Ia relaci6n que hay entre un pfxel y su vecindad (ver expresi6n (3) y para conocer mas detalles consultar (Le6n and Garcia, 2016))

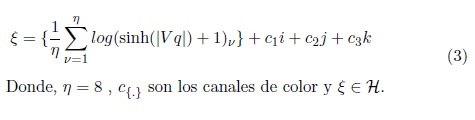

Es claro que por cada imagense tienen ahora dos (una por cada espacio de color), para reducir estoy concervar la relaciones entre los diferentes canales (8 canales) es construido otro quaeernion a partir del módulo y su parte real. Esto permite trabajar sobre una sola imagen representada por full-quaternions (ver expresión (4), cada píxel es representado por un full-quaternion) que tiene la información de ambos espacios de color y del contraste claro oscuro.

]]>

Donde, Ω ∈ H, t{.} y |ξ{.}| , son la parte real y módulo del quaternion respectivamente en los diferentes espacios de color.

Mapa de regiones salientes local

Las imágenes son divididas en pequeños parches para buscar los full-quaternions que tienen rasgos poco frecuentes al resto, siendo una condición del enfoque bottom up. En la presente investigación se desarrollaron dos métodos como se describe a continuación:

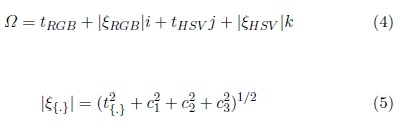

El primer método se basa en obtener un vector de rasgo compuesto por dos características del full-quaternion la fase (ver expresión (6)) y módulo, también sus valores medios en el parche. Después mediante la distancia euclidiana se obtiene la diferencia de cada full-quaternions al vector de media, siendo la mayor distancia la de más probabilidad de ser diferente al resto de los full-quaternions vecinos. El valor obtenido en la explicación anterior permite obtener un mapa para cada imagen.

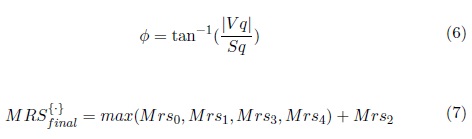

Son obtenido un total de 5 mapas de RS, pero es necesario combinarlos para obtener uno solo . El M RSefinal (Mapa de regiones salientes espacial final) es obtenido mediante la expresión (7).

Donde, M rs{.} es el mapa de RS en cada nivel de la pirámide Gaussiana y ![]() es para {e},{mLBP } y {g} región saliente espacial, región saliente espacial con descriptor {mLBP } y región saliente global respectivamente.

es para {e},{mLBP } y {g} región saliente espacial, región saliente espacial con descriptor {mLBP } y región saliente global respectivamente.

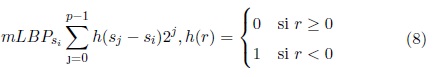

El segundo método se basa en codificar cada full-quaternion mediante una variante de patrón local binario (LBP, en inglés), diferente al trabajo de (Lan et al., 2014) donde desarrolla un quaternionic local binary pattern a partir de la fase obtenida por el producto de un quaternion puro por un quaternion puro unitario (|V q| = 1), en este trabajo se presenta una variante para evitar la multiplicación y trabajar solamente con los full-quaternions que se construyeron mediante la expresión (4) lo cual fue desarrollado como sigue (al igual que el método anterior el análisis es desarrollado en cada parche):

Mapa de regiones salientes global

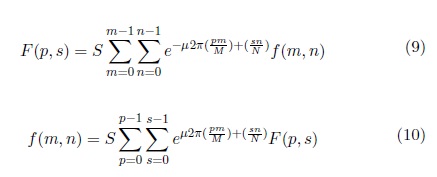

El trabajo de (Liu and Hu, 2016) demuestra como modificando el espectro del módulo es posible obtener mapas de regiones salientes en el dominio de la frecuencia de Fourier. La transformada rápida de Fourier para quaternions (Ell et al., 2014) es utilizada para obtener los diferentes mapas de RS de forma global. Diferente al trabajo anterior, los datos utilizados son de otra naturaleza a partir de la expresión (4) lo que es necesario una configuración en la reconstrucción de los full-quaternions de entrada a la transformada inversa de Fourier como sigue:

Donde, ![]() la exprsión (9) and (10) son la directa e inversa de la transformada de Fourier para quaternions respectivamente, µ un quaeernion puro unitario, p y s son los coeficientes; de frecuencias, m y n son las coordenadas espaciales de la imagen.

la exprsión (9) and (10) son la directa e inversa de la transformada de Fourier para quaternions respectivamente, µ un quaeernion puro unitario, p y s son los coeficientes; de frecuencias, m y n son las coordenadas espaciales de la imagen.

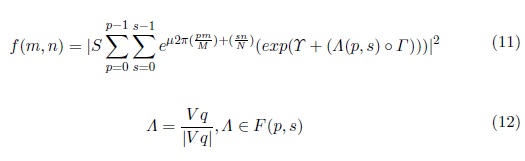

Para obtener el mapa final global primero es suavizado el espectro del módulo mediante un filtro pasa baja de tipo Gaussiano con el objetivo de resaltar las regiones; mas estables; y reducir aquellas con pequeños bordes. La reconstrucción de la exprsión (10) es como sigue:

Donde,![]() son el eje propio y la fase,

son el eje propio y la fase,![]() el módulo espectral modificado por el filtro y o es el producto Hadamard. El mapa de RS final global

el módulo espectral modificado por el filtro y o es el producto Hadamard. El mapa de RS final global ![]() es obtenido por la expresión (7).

es obtenido por la expresión (7).

Mapa de regiones salientes final

]]> El mapa de las regiones salientes final MRSfinal de la imagen original es conformado por la combinación de los tres mapas obtenidos en las secciones anteriores y su pooterior ponderación y refinamiento.Antes de combinar los mapas es necesario aplicar un filtro radial a cada uno para suavizar los mapas y conformar pequeñas areas, (ver expresión (13) y Figura 2,(c, d, e)).

![]()

Donde, ψes el filtro radial, {α, β, δ} son parámetros de peso para los mapas y {*} producto convolución.

La teoría nombrada center bia (Buso et al., 2015) se basa en la suposición que los objetos salientes por lo general se encuentran en el centro de la imagen, por lo que al mapa M S se le aplica una función para ponderar los valores según la distancia de los pixeles al centro de la imagen como sigue:

![]()

Donde, υ y ρ son las coordenadas del centro de la imagen.

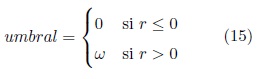

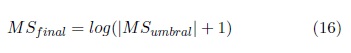

En la práctica es necesario conocer solamente en el mapa de RS aquellos valores asociados a los objetos, por esta razón a diferencia de trabajos previos se realiza una umbralización adaptativa del mapa MScb para eliminar los valores muy alejados del objeto de interés (ver expresión (15)). Para obtener un mejor balance en el mapa final M RSfinal partiendo del criterio que un mismo objeto saliente puede tener partes con diferentes probabilidades de ser observada (ver Figura 2,f ), se realiza otro proceso de refinamiento como muestra la expresión (16):

Donde, ω es el valor del mapa MScb (m, n), r es el umbral siendo la suma de la media más la desviación estándar en MScb.

]]>

RESULTADOS Y DISCUSIÓN

El desempeño del algoritmo propuesto es validado en la base de datos ECSSD-1000 (Yan et al., 2013) que contiene 1000 imágenes con diferentes tamaños y tiene objetos que semánticamente son significativos al ser humano. La base de datos ofrece la máscara de las regiones salientes que fueron etiquetadas por 5 personas.

Los parámetros utilizados fueron: δ = 1· 3, β = 2, δ = 1· 7, µ = (i, j, k)/![]()

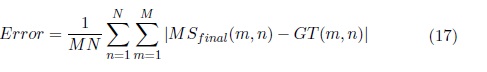

La métrica utilizada para validar el algoritmo propuesto es el error medio absoluto (a menor valor de error,mejor es el desempeño del algoritmo) que permite comparar la similitud entre el mapa de las regiones salientes obtenido y el ground truths (GT) de la base de datos. Los algoritmos utilizados para la comparación fueron: HS (Yan et al., 2013), PCA (Margolin et al., 2013), XL (Xie et al., 2013), GC (Cheng et al., 2013), Wco(Zhu et al., 2014), HC (Cheng et al., 2015), LPS(Li et al., 2015), BL(Tong et al., 2015), Linhua (Linhua et al., 2017).

Se observa en la figura 4 como el algoritmo propuesto logra disminuir el error hasta un 20 % en comparación con los otros métodos. Esto es posible por la combinación de varias técnicas como la obtención de mapas mediante los rasgos de los full-quaternions en el espacio de las frecuencia y espacial que resaltan las regiones salientes. También la combinación de los mapas y el proceso de refinamiento permite eliminar los valores insignificantes y destacando los asociados a los objetos salientes. Sin embargo todavía es necesario disminuir el error para tener mayor precisión en la detección de regiones salientes. Una de las causa que atentan en disminuir el error es el balance en la parametrización de las funciones empleadas y no es una tarea fácil buscar un balance óptimo para las imágenes en la base de datos, por estar conformada por múltiples escenarios complejos.

]]> CONCLUSIONES

La representación de la imagen mediante Full-quaternions permitió combinar los espacio de color RGB y HSV con el contraste (claro - oscuro) en una sola imagen con 4 canales, donde se obtuvieron rasgos correlacionados que permiten crear mapas de regiones salientes local y global. La combinación de los mapas con un refinamiento de los valores final logro mejorar los resultados en la base de datos ESSCD-1000. Para trabajos futuros se debe trabajar en el empleo de algoritmos de aprendizaje basados en Full-quaternions para buscar parámetros óptimos ante la complejidad que muestran los escenarios en el mundo real.

REFERENCIAS

Caglar Aytekin, Alexandros Iosifidis, and Moncef Gabbouj. Probabilistic saliency estimation. arXiv preprint arXiv:1609.03868, 2016.

Peter Burt and Edward Adelson. The laplacian pyramid as a compact image code. IEEE Transactions on communications, 31(4):532–540, 1983.

Vincent Buso, Jenny Benois-Pineau, and Jean-Philippe Domenger. Geometrical cues in visual saliency models for active object recognition in egocentric videos. Multimedia Tools and Applications, 74(22):10077–10095, 2015.

Ming-Ming Cheng, Jonathan Warrell, Wen-Yan Lin, Shuai Zheng, Vibhav Vineet, and Nigel Crook. Efficient salient region detection with soft image abstraction. In Proceedings of the IEEE International Conference on Computer vision, pages 1529–1536, 2013.

Ming-Ming Cheng, Niloy J Mitra, Xiaolei Huang, Philip HS Torr, and Shi-Min Hu. Global contrast based salient region detection. IEEE Transactions on Pattern Analysis and Machine Intelligence, 37(3):569–582, 2015.

]]>Todd A Ell, Nicolas Le Bihan, and Stephen J Sangwine. Quaternion Fourier transforms for signal and image processing. John Wiley & Sons, 2014.

Erkut Erdem and Aykut Erdem. Visual saliency estimation by nonlinearly integrating features using region covariances. Journal of vision, 13(4):11–11, 2013.

Dan Hu, Shaohui Qian, Yan Wang, and Weiyu Yu. Saliency region detection via local and global. 2015.

Rushi Lan, Yicong Zhou, Yuan Yan Tang, and CL Philip Chen. Person reidentification using quaternionic local binary pattern. In Multimedia and expo (ICME), 2014 IEEE international conference on, pages 1–6. IEEE, 2014.

Reynolds León and Edel García. Mejoramiento de la apariencia en imágenes de personas mediante los cuater- niones. In Memorias del XIV Congreso Nacional de Reconocimiento de Patrones, 2016.

Hongyang Li, Huchuan Lu, Zhe Lin, Xiaohui Shen, and Brian Price. Inner and inter label propagation: salient object detection in the wild. IEEE Transactions on Image Processing, 24(10):3176–3186, 2015.

Yin Li, Xiaodi Hou, Christof Koch, James M Rehg, and Alan L Yuille. The secrets of salient object segmenta- tion. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 280–287, 2014.

]]> Jiang Linhua, Zhong Hui, and Lin Xiao. Saliency detection via boundary prior and center prior. International Robotics & Automation Journal, 2(4):2–8, 2017.Shangwang Liu and Jianlan Hu. Visual saliency based on frequency domain analysis and spatial information. Multimedia Tools and Applications, 75(23):16699–16711, 2016.

Ran Margolin, Ayellet Tal, and Lihi Zelnik-Manor. What makes a patch distinct? In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 1139–1146, 2013.

Jo˜ao Pedro Morais, Svetlin Georgiev, and Wolfgang Spr¨oßig. Real quaternionic calculus handbook. Springer, 2014.

Omprakash S Rajankar and Uttam D Kolekar. Scale space reduction with interpolation to speed up visual saliency detection. International Journal of Image, Graphics and Signal Processing, 7(8):58, 2015.

Na Tong, Huchuan Lu, Xiang Ruan, and Ming-Hsuan Yang. Salient object detection via bootstrap learning. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 1884–1892, 2015.

Lijun Wang, Huchuan Lu, Xiang Ruan, and Ming-Hsuan Yang. Deep networks for saliency detection via local estimation and global search. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 3183–3192, 2015.

Changqun Xia, Jia Li, Xiaowu Chen, Anlin Zheng, and Yu Zhang. What is and what is not a salient object? learning salient object detector by ensembling linear exemplar regressors. In IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2017.

]]> Yulin Xie, Huchuan Lu, and Ming-Hsuan Yang. Bayesian saliency via low and mid level cues. IEEE Transac- tions on Image Processing, 22(5):1689–1698, 2013.Qiong Yan, Li Xu, Jianping Shi, and Jiaya Jia. Hierarchical saliency detection. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 1155–1162, 2013.

Chun-yan Yu, Wei-shi Zhang, and Chun-li Wang. A saliency detection method based on global contrast. International Journal of Signal Processing, Image Processing and Pattern Recognition, 8(7):111–122, 2015.

Wangjiang Zhu, Shuang Liang, Yichen Wei, and Jian Sun. Saliency optimization from robust background detection. In Proceedings of the IEEE conference on computer vision and pattern recognition, pages 2814–2821, 2014.

Recibido: 04/11/2017

Aceptado: 07/09/2018