Reconocimiento biométrico de rostros mediante el análisis de datos funcionales de sus modelos tridimensionales

Biometric recognition of faces through the analysis of functional data of their three-dimensional models

Francisco José Silva Mata1*, Anier Revilla Eng1, Isneri Talavera Bustamante1, Ángel Augier2, Stefano Berretti3

1 Centro de Aplicaciones de Tecnologías de Avanzada (CENATAV). 7a No. 21406 e/ 214 and 216, Siboney, Playa, La Habana, Cuba. CP 12200, {fjsilva, italavera}@cenatav.co.cu

2 Universidad de la Habana, Cuba ]]>

3 Universidad de Florencia, Italia

*Autor para la correspondencia: fjsilva@cenatav.co.cu

RESUMEN

La representación de los datos del rostro registrados en tres dimensiones con el objetivo de identificar personas, aunque resuelve los problemas de pose e iluminación que afectan el rendimiento de los sistemas basados en dos dimensiones, enfrenta el problema de la alta dimensión de los datos, lo cual provoca errores de clasificación a causa de la llamada “maldición de la dimensionalidad”. Por esta razón la reducción de la dimensión manteniendo altas tasas de reconocimiento es objetivo prioritario de los métodos de representación de los objetos biométricos. Como resultado de esta investigación se propone la representación de la información tridimensional mediante funciones, lográndose una representación compacta que aporta otras ventajas adicionales como la de representar la correlación entre los valores vecinos, y una notable simplificación del cálculo computacional. Los resultados alcanzados demuestran la validez del análisis funcional como vía de reconocimiento de rostros en tres dimensiones completos y con partes perdidas.

Palabras clave: Análisis de datos funcionales, reconocimiento biométrico, reducción de dimensión

ABSTRACT

The representation of face data recorded in three dimensions with the aim of identifying people, while solving the problems of pose and illumination that affect the performance of two-dimensional systems, faces the problem of high data dimension, which causes classification errors because of the so-called "curse of dimensionality". For this reason, the reduction of the dimension maintaining high recognition rates is a priority objective of the methods of representation of the biometric objects. As a result of this research, we propose the representation of three-dimensional information through functions, achieving a compact representation that provides additional advantages such as representing the correlation between neighboring values, and a notable simplification of computational computation. The results obtained demonstrate the validity of the functional analysis as a way of recognition of faces in three dimensions complete and with lost parts.

]]> Key words: Functional data analysis, biometric recognition, dimension reduction

INTRODUCCIÓN

El reconocimiento de personas, consiste en determinar la identidad de las personas mediante sus características físicas y/o de comportamiento. El reconocimiento biométrico abarca el procesamiento automático de la escritura, las huellas digitales, la geometría de la mano, el rostro y sus partes, la forma de caminar, la voz, o la combinación de estas en los llamados sistemas multibiométricos (Ross, Nandakumar & Jain, 2006). En particular el reconocimiento del rostro presenta ventajas sobre otros sistemas biométricos, en cuanto a que es una técnica no invasiva y puede ser utilizada tanto en aplicaciones públicas como encubiertas. Sin embargo, algunos elementos complejizan el proceso de reconocimiento de rostro; como las variaciones de las poses y las expresiones, las distintas fuentes de iluminación, las sombras, el comportamiento especular de la piel, la oclusión de sus partes por espejuelos o prendas de vestir, el pelo, los maquillajes y el envejecimiento. Con el objetivo de enfrentar algunos de estos problemas y teniendo en cuenta el desarrollo que en la última década han tenido los dispositivos de captura tridimensionales (3d), puede asegurarse que, en el futuro en vez de utilizar las imágenes de fotos o videos en dos dimensiones, se utilicen imágenes 3d en los sistemas de reconocimiento de rostro, las cuales tienen como ventajas principales que no son afectadas por algunos de los factores anteriormente mencionados.

Las nuevas tecnologías de captura 3d abarcan escáneres 3d (Boehnen & Flynn, 2005), sistemas estereoscópicos (Zappa et al., 2010).), sistemas con luz estructurada (Paysan et al., 2009) o sistemas de imágenes de rango (Yan & Bowyer, 2007) que se obtienen mediante dispositivos que sensan la profundidad como las cámaras Kinect (Li et al., 2013). Comúnmente estas tecnologías se complementan con aplicaciones que permiten el perfeccionamiento de estos modelos, mediante el rellenado de huecos (Xu et al., 2009), la regularización de la información (Zhang, Z. ,2012) y el suavizado (Wang et al., 2010).

Los modelos 3d sin embargo presentan como desventaja principal la alta dimensión de los datos y la forma no estructurada de la información de estos, lo cual dificulta su uso en las aplicaciones reales. Estos contienen miles de puntos en forma de nube que representan una superficie, que puede ser complementada con la información de color, para ofrecer una visualización realista de los objetos, sin embargo, este número alto de puntos afecta el trabajo de clasificación, debido al conocido problema de la maldición de la dimensión (del inglés: curse of dimensionality) (Keogh & Mueen, 2011). A esta dificultad se suma el hecho de que en los escenarios posibles de trabajo los modelos 3d de rostro completos y con alta calidad solo están almacenados en bases de datos (BD) previamente registrados con condiciones controladas de captura, pero aquellos capturados fuera de línea en condiciones no controladas, pueden resultar incompletos, presentando partes perdidas u ocluidas.

Con vistas a resolver la primera desventaja planteada anteriormente se han aplicado en trabajos previos de reconocimiento de rostro 3d métodos de reducción de la dimensión, lográndose tasas de reconocimiento superiores al 90% (Russ et al., 2006; Wei & Lie, 2010). Sin embargo, la dimensión de las descripciones logradas en estos trabajos aún es alta, y la eficacia medida como tasa de reconocimiento no alcanza valores que permitan ser aplicados en sistemas reales. Esta situación problemática determinó como objetivo principal de esta investigación, la obtención de una nueva representación de modelos 3d de rostro de menor dimensión que las conocidas y que permitiera a su vez obtener mayores tasas de reconocimiento. Para lograrlo se decidió utilizar representaciones funcionales, las cuales permiten una gran compactación de la información, recuperan el carácter continuo original de los datos, facilitan el cálculo y contienen de forma implícita la relación entre las variables. Esta forma de trabajo con los datos está fundamentada en los trabajos de Ramsay (2006) sobre el análisis de datos funcionales (en inglés: FDA). Basado en lo anteriormente planteado se trazó como objetivo específico la optimización de la representación funcional de los modelos 3d de rostros. Finalmente se realizaron experimentos de reconocimiento con estas representaciones para validar sus resultados.

]]> MATERIALES Y MÉTODOS

Fundamentos

Nuevo proceso de reconocimiento de rostros 3d basado en el análisis de datos funcionales (FDA)

La representación y reconocimiento de los rostros 3d se ha llevado a cabo mediante una secuencia similar a la generalidad de los procesos de reconocimiento biométrico en cuanto a sus bloques lógicos (Zhang, 2013), aunque para el caso de la aplicación del análisis funcional este tiene algunas particularidades que serán descritas a continuación siguiendo el esquema de la Figura 1. La primera etapa consiste en la captura de los modelos 3d, los cuales pueden ser capturados directamente de la información espacial tal como fue descrito en la introducción, o pueden ser sintetizados a partir de imágenes 2d o de imágenes de video (Park & Jain, 2007). A este paso sigue un proceso de normalización, donde es fundamental la alineación. La etapa de trabajo con los datos perdidos es opcional y depende de si los modelos a identificar están incompletos. La etapa de selección de bases se ha ubicado delante de la representación ya que debe determinarse previamente el conjunto de funciones que va a ser utilizado. La representación funcional obtenida es optimizada mediante una correcta selección de coeficientes tanto en su número total como en cuáles serán utilizados. Un paso adicional de reducción de la dimensión contribuye a elevar la eficiencia y eficacia del sistema, cuyo paso final consiste en el cotejo de las representaciones, mediante el cálculo de distancias funcionales.

Alineación

Una vez capturados los modelos y realizado el procesamiento mencionado en la sección anterior, el próximo paso es el de alineación. El proceso de alineación consiste en encontrar una posición del origen de coordenadas y las direcciones de los ejes correspondientes única respecto a cada objeto (rostro en este caso). La necesidad de realizar el paso de alineación se debe a que cuando los objetos son escaneados difícilmente los ejes de referencia del objeto final, aun siendo de la misma persona resulten iguales en posición y dirección. El problema de la alineación de los modelos en el caso de las representaciones funcionales es crucial, ya que para que dos funciones sean comparables, sus valores deben estar referenciados al mismo origen de coordenadas y a los mismos ejes. La alineación necesita generalmente puntos de referencia, que deben ser detectables como primer requerimiento. El segundo requerimiento es que tiene que existir un patrón para la alineación de todos los modelos y el patrón escogido o creado debe ser el mejor posible. En el artículo de F.J. Silva-Mata (2016), se aborda el problema de la alineación detalladamente. Sin embargo, la solución planteada logra resolver satisfactoriamente el problema de la alineación de rostros 3d cuando los modelos están completos, es decir, que no tienen partes perdidas (Berretti, et al, 2013), ni presenten problemas de oclusión (Drira et al., 2013). Como se ve en la Figura 2(izquierda), la alineación de los modelos se realiza mediante el cálculo de los ejes principales de los rostros, que coinciden con los vectores propios de un subconjunto de la nube de puntos de cada rostro. Para el proceso de alineación de rostros completos es fundamental localización correcta del punto “pronasal” (punto más prominente de la nariz), para lo cual se ha utilizado el método de (Xu et al. 2006). En la Figura 2(derecha), pueden verse las características geométricas que facilitan su localización.

El punto “pronasal” en un porciento alto de los casos está presente, aún en rostros con partes perdidas como se muestra en la Figura 3. Las oclusiones por prendas superpuestas sobre el rostro comúnmente no ocluyen este punto, como puede observarse en la Figura 3. El algoritmo de identificación del “pronasal” (Xu, et al., 2006), sin embargo; no trabaja bien cuando el conjunto de puntos vecinos a este no está completo. Por esta razón otros puntos característicos del rostro como los utilizados en los modelos activo de forma (ASM: siglas del inglés Active Shape Model) (Sohail & Bhattacharya, 2008) pueden ser usados. Los puntos interiores de los ojos (“endocanthions”) por ejemplo, utilizados como referencia por algunos autores para la alineación de modelos, ver Figura 4 (izquierda y centro) (Wei et al., 2010), son difíciles de detectar automáticamente en el caso 3d. Una alternativa posible para encontrar la parte del rostro correspondiente y alinearla cuando esta tiene partes perdidas u ocluidas, es la utilización de la geometría diferencial para la determinación de puntos característicos, y su caracterización mediante descriptores locales. En la Figura 4 (derecha) se muestran tres tipos de puntos extremos locales, según (Polthier et al., 2007). La correspondencia entre los puntos de la parte del rostro a identificar y del patrón es utilizada para detectarla, localizarla y alinearla.

Dominio de representación

Para que las representaciones funcionales sean comparables, el dominio de estas debe coincidir. Normalmente el dominio de representación de los rostros se toma en un plano “xy”, cuya normal coincide con la dirección del vector normal al punto “pronasal” y cuyo origen se encuentra a una determinada distancia de este. De esta manera la función tomará valores en el eje z para cada par (x,y). Otro elemento a tener en cuenta sobre el dominio es que el mismo se ha restringido para evitar utilizar zonas de representación ruidosas, o poco identificativas. De acuerdo a investigaciones precedentes (Bowyer et al., 2006), algunos autores señalan la parte del rostro centrada en el “pronasal” y que contiene la boca y los ojos, como una región discriminativa de estos. El punto “pronasal” es prácticamente un centro natural de este dominio respecto a sus coordenadas ![]() . La Figura 5(izquierda) presenta dos dominios de representación funcional de rostros 3d y sus correspondientes valores de la superficie (z).

. La Figura 5(izquierda) presenta dos dominios de representación funcional de rostros 3d y sus correspondientes valores de la superficie (z).

Representación funcional inicial y completamiento en caso de partes perdidas.

]]> Una vez alineados (modelo o parte) es necesario definir una malla de muestreo que coincidentemente es utilizada para la representación funcional inicial de los modelos 3d de la base de datos (BD). Mediante esta malla de control los datos que forman una nube de puntos son representados funcionalmente, resultando una representación reducida en dimensión respecto al modelo inicial. Los requisitos que tiene que cumplir esta malla de control están relacionados con el cumplimiento del teorema de Nyquist-Shannon y con las bases que van a ser utilizadas para esta representación (D Porro-Muñoz et al., 2014). El modelo recuperado mediante esta malla normalmente es suavizado, manteniendo normalmente la posibilidad de una visualización con valor identificativo. La segunda función de esta malla es servir como plantilla para el completamiento de las partes vacías de los modelos incompletos. Una vez realizada la representación funcional sobre esta malla, resulta trivial determinar aquellos nodos de la malla a los cuales no pudo asignarse ningún valor durante el ajuste del modelo a identificar. Estos nodos vacíos en la malla de control son llenados con los valores de los nodos de los modelos con que se va a comparar en cada caso y que si tienen valor asignado. En la Figura 5(derecha) se muestra el completamiento de un modelo incompleto. En el caso de que los modelos no sean de la misma persona pueden ocurrir grandes saltos o diferencias en la frontera entre las dos partes empalmadas, pero no ocurre así cuando los modelos son de la misma persona. Se sobreentiende que para poder realizar este proceso de completamiento tienen que almacenarse los valores de la imagen recuperados mediante la evaluación de la función representativa inicial de los datos. Esto provoca un consumo adicional de memoria, en los casos que el modelo a identificar esté incompleto en la zona efectiva de comparación y una repetición del proceso de ajuste para cada modelo a comparar.Selección de las funciones bases y la malla de control.

Las representaciones funcionales suelen realizarse mediante las llamadas funciones bases. La utilización de funciones bases trae consigo numerosas ventajas (F. J. Silva-Mata et al., 2016). De esta forma la expresión general de la función para el caso de datos tridimensionales de rostro queda según la ecuación 1:

![]()

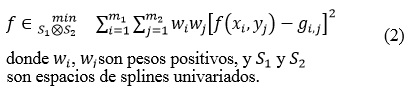

Donde ![]() denota el conjunto de las K funciones bases, y {ck} representan los coeficientes de la expansión. El paso de selección de bases resulta crucial para la obtención de una representación funcional optimizada como se describe en (F. J. Silva-Mata et al., 2016). De forma resumida, la selección de bases comienza con la selección del conjunto y la determinación del número de coeficientes de la representación inicial (desde el de menor orden hasta el de mayor orden posible del número K determinado), es decir el número de coeficientes que minimiza el error de representación respecto a los datos originales. La Ecuación 2, muestra este concepto para un ejemplo de conjunto base (splines).

denota el conjunto de las K funciones bases, y {ck} representan los coeficientes de la expansión. El paso de selección de bases resulta crucial para la obtención de una representación funcional optimizada como se describe en (F. J. Silva-Mata et al., 2016). De forma resumida, la selección de bases comienza con la selección del conjunto y la determinación del número de coeficientes de la representación inicial (desde el de menor orden hasta el de mayor orden posible del número K determinado), es decir el número de coeficientes que minimiza el error de representación respecto a los datos originales. La Ecuación 2, muestra este concepto para un ejemplo de conjunto base (splines).

donde wi , wj son pesos positivos, y S1 y S2 son espacios de splines univariados.

El ajuste mediante el método de los mínimos cuadrados se lleva a cabo aplicando la descomposición en valores singulares (SVD). En nuestro caso la determinación del número K se realizó mediante el método de “bootstrap” cuya principal ventaja es la independencia de las particularidades de la descripción, y la de no necesitar conocer de antemano la “distribución de los datos o los errores de modelación” (Iskander, 2004). Posteriormente la selección de coeficientes se llevó a cabo análogamente a como se hace la la selección de atributos en representaciones vectoriales, mediante el método de selección “univariada” (Harol et al., 2007). Los mejores resultados se obtuvieron con el método de estadística de Chi-cuadrado (χ2) y el de ganancia de la información o entropía respecto a la clase. Por último, se realizó una reducción final de la dimensión mediante el aprendizaje de variedades (del inglés: manifolds), en este caso “variedades funcionales”, aplicando el análisis de componentes principales funcionales (en inglés: FPCA) (P-Muñoz, D.et al, 2014). El conjunto final de coeficientes que representan unívocamente cada rostro finalmente es mucho menor que el K inicial calculado. La relación entre el conjunto de funciones bases seleccionado y el tipo y forma de la malla a utilizar es ejemplificado en la Figura 6 (izquierda y centro). El hecho de utilizar mallas uniformes simplifica las representaciones. En la Figura 6 (izquierda) se ha representado una malla rectangular en coordenadas cartesianas (x,y), para la representación mediante B-splines (splines bivariadas) y en la Figura 6 (centro) se ha representado la malla circular en coordenadas polares ![]() para la representación mediante los polinomios circulares de Zernike (D. Porro-Muñoz et al., 2014).

para la representación mediante los polinomios circulares de Zernike (D. Porro-Muñoz et al., 2014).

Cotejo de representaciones funcionales

Aunque existen varias definiciones de distancia entre funciones, se ha utilizado la distancia inducida por el producto interno de funciones definida por la Ecuación 3 correspondiente a la norma Ln (Kolmogorov et al., 1999). Particularmente se utilizaron la Distancia de Manhattan y la Distancia Euclidiana funcionales coincidiendo con las que dieron mejores resultados en cada caso.

]]>

RESULTADOS Y DISCUSIÓN

Los experimentos se dividieron en tres casos. El primero fue de reconocimiento de rostros completos. Se usaron las BD de rostros 3d Gavab (Moreno et al., 2004) y UF-3D (Bagdanov et al,2011), con los rostros en posición frontal procesados para eliminar ruidos y huecos. Se utilizaron dos modelos de cada persona y se alinearon. El patrón de alineación fue obtenido mediante el criterio de correlación (F. J. Silva Mata et al. 2016). Se utilizaron dos conjuntos de funciones bases, las B-Splines (BVS) y los polinomios de Zernike, circulares y anulares (CZP y AZP), en dos esquemas, global (todo el objeto) y local (división en dos/tres regiones) respectivamente, G y L en cada caso, ver Figura 6 (derecha). La Tabla 1, muestra los mejores resultados obtenidos, el total de coeficientes, la distancia funcional, y la tasa de reconocimiento (RR, inglés: recognition rate) de 1 vs. N. Los resultados del primer experimento (rostros completos) demostraron la notable reducción de dimensión de estas representaciones y las altas tasas de reconocimiento logradas entre el 95% y el 100%, (Porro- Muñoz et al., 2014), y un total de coeficientes entre 24 y 48 (dimensiones aprox. 1000 veces menores que las originales).

En el segundo experimento de reconocimiento (1 vs. N), se usaron las B-Splines en los esquemas Global y Local y la base de datos BD UF-3D en 3 posiciones: frontal, lateral izquierdo, lateral derecho. Ver Tabla 2.

El tercer experimento repitió en lo básico el segundo experimento. La variación introducida en este fue la identificación de modelos con partes perdidas. Para esto se usaron máscaras (Figura 3 (izquierda)) para simular la ausencia de datos en la BD GavabDB (Moreno et al., 2004). Estas se aplicaron en modelos alineados y con diferentes expresiones. Los resultados se presentan en la Tabla 3.

En el segundo y tercer experimento las tasas de reconocimiento de rostros con partes perdidas resultaron superiores al 93.3%. Estos resultados son lógicos, teniendo en cuenta que aunque los modelos están incompletos (laterales), quedaron prácticamente alineados al ser rotados para su completamiento, lo cual consideramos influyó positivamente en los resultados. En el tercer experimento, las máscaras para simular partes perdidas se aplicaron sobre modelos alineados. En general los resultados demostraron que en rostros 3d completos (dominio completo) se logran excelentes resultados de eficacia y de eficiencia computacional al disminuir notablemente el tamaño de las representaciones, ahorrando espacio de memoria y tiempo computacional. Sin embargo, a pesar de las altas tasas de reconocimiento obtenidas, no se puede aseverar lo mismo respecto a la eficiencia, ya que es necesario mantener en memoria una copia del modelo original representado funcionalmente, para realizar el completamiento de las partes perdidas y volver a ajustar la función (para todos los modelos), lo que aumenta el costo computacional y el tiempo de ejecución.

]]> Futuras investigacionesLas futuras investigaciones deben estar encaminadas a la obtención de métodos de búsqueda y alineación de las partes incompletas en casos que simulen la realidad, es decir con variaciones notables de la pose y cuando las partes perdidas representen una parte considerable del rostro. Además debe buscarse una solución que evite el almacenamiento del modelo recuperado original del rostro para su completamiento. En esta dirección es necesario buscar nuevas representaciones funcionales que permitan estas posibilidades.

CONCLUSIONES

Las representaciones funcionales de rostros 3d lograron un alto grado de compactación de las representaciones y altas tasas de reconocimiento en rostros completos o cuando estando incompletos las partes a comparar están alineadas lo suficientemente bien, siendo las tasas de reconocimiento en algunos casos mejores que las del estado del arte. La alineación de los modelos y la selección de las bases son cruciales para el buen desempeño de estos métodos de reconocimiento aplicando el FDA. Es posible aplicar representaciones funcionales en el reconocimiento de rostros con partes perdidas, pero es necesario optimizar los métodos de detección, alineación, representación y cotejo de las partes incompletas.

REFERENCIAS BIBLIOGRÁFICAS

BAGDANOV, A. D., DEL BIMBO, A. & MASI, I. (2011). The Florence 2D/3D hybrid face dataset. Proceedings of the 2011 joint ACM workshop on Human gesture and behavior understanding (pp. 79-80). ACM.

BERRETTI, S., DEL BIMBO, A., & PALA, P. (2013). Sparse matching of salient facial curves for recognition of 3-D faces with missing parts. Information Forensics and Security, IEEE Transactions on, 8(2), 374-389.

]]> BERRETTI, S., WERGHI, N., DEL BIMBO, A., & PALA, P. (2013). Matching 3D face scans using interest points and local histogram descriptors. Computers & Graphics, 37(5), 509-525.BOEHNEN, C., & FLYNN, P. (2005, June). Accuracy of 3D scanning technologies in a face scanning scenario. In 3-D Digital Imaging and Modeling, 3DIM 2005. Fifth International Conference on (pp. 310-317). IEEE.

BOWYER, K. W., CHANG, K., & FLYNN, P. (2006). A survey of approaches and challenges in 3D and multi-modal 3D+ 2D face recognition. Computer vision and image understanding, 101(1), 1-15.

DRIRA, H., BEN AMOR, B., SRIVASTAVA, A., DAOUDI, M., & SLAMA, R. (2013). 3D face recognition under expressions, occlusions, and pose variations. Pattern Analysis and Machine Intelligence, IEEE Transactions on, 35(9), 2270-2283.

F. J. SILVA-MATA, D. MUNOZ, S. BERRETTI, V. MENDIOLA-LAU, I. TALAVERA., N. HERNÁNDEZ, Y. M. DIAZ (2016) Alineación de Señales e imágenes durante la aplicación del Análisis de Datos Funcionales, RCF Vol33-1E

F. J. SILVA-MATA, D. MUÑOZ, V. MENDIOLA-LAU, I. TALAVERA, & A. AUGIER (2016) Criterios y métodos de selección de bases y su impacto en el análisis de datos funcionales. RCF Vol33-1E

HAROL, A., LAI, C., PĘKALSKA, E., & DUIN, R. P. (2007). Pairwise feature evaluation for constructing reduced representations. Pattern Analysis and Applications, 10(1), 55-68.

ISKANDER, D. R., MORELANDE, M. R., COLLINS, M. J. & BUEHREN, T. (2004). A refined bootstrap method for estimating the Zernike polynomial model order for corneal surfaces. Biomedical Engineering, IEEE Transactions on, 51(12), 2203-2206

KEOGH, E., & MUEEN, A. (2011). Curse of dimensionality. In Encyclopedia of Machine Learning (pp. 257-258). Springer US.

KOLMOGOROV, A.N., FOMIN, S.V. Nonparametric Functional Data Analysis Theory and Practice. Dover Publications (1999)

LI, B. Y., MIAN, A., LIU, W., & KRISHNA, A. (2013, January). Using kinect for face recognition under varying poses, expressions, illumination and disguise. In Applications of Computer Vision (WACV), 2013 IEEE Workshop on (pp. 186-192). IEEE.

MORENO, A. B., & SÁNCHEZ, A. (2004, March). GavabDB: a 3D face database. In Proc. 2nd COST275 Workshop on Biometrics on the Internet, Vigo (Spain) (pp. 75-80).

PARK, U., & JAIN, A. K. (2007). 3D model-based face recognition in video. In Advances in Biometrics (pp. 1085-1094). Springer Berlin Heidelberg.

P-MUÑOZ, D., SILVA MATA, F. J., HERNÁNDEZ, N. & TALAVERA, I. (2014). El análisis de datos funcionales como alternativa para el reconocimiento automático de imágenes biométricas: aplicación en el iris. Computación y Sistemas, 18(1), 111-121.

PAYSAN, P., KNOTHE, R., AMBERG, B., ROMDHANI, S., & VETTER, T. (2009, September). A 3D face model for pose and illumination invariant face recognition. In Advanced video and signal based surveillance, 2009. AVSS'09. Sixth IEEE International Conference on (pp. 296-301). IEEE.

POLTHIER, K., HILDEBRANDT, K., PREUSS, E., & REITEBUCH, U. (2007). JavaView, version 3.95.

PORRO-MUÑOZ, D., SILVA-MATA, F. J., REVILLA-ENG, A., Talavera-Bustamante, I., & Berretti, S. (2014). 3D Face Recognition by Functional Data Analysis. Progress in Pattern Recognition, Image Analysis, Computer Vision, and Applications (pp. 818- 826). Springer International Publishing.

RAMSAY, J. O. (2006). Functional data analysis. John Wiley & Sons, Inc.

ROSS, A. A., NANDAKUMAR, K., & JAIN, A. (2006). Handbook of multibiometrics (Vol. 6). Springer Science & Business Media.

RUSS, T., BOEHNEN, C., & PETERS, T. (2006). 3D face recognition using 3D alignment for PCA. Computer Vision and Pattern Recognition, IEEE Computer Society Conference on (Vol. 2, pp. 1391-1398). IEEE.

SOHAIL, A. S. M., & BHATTACHARYA, P. (2008). Detection of facial feature points using anthropometric face model. Signal Processing for Image Enhancement and Multimedia Processing (pp. 189-200). Springer US.

WANG, Y., LIU, J., & TANG, X. (2010). Robust 3D face recognition by local shape difference boosting. Pattern Analysis and Machine Intelligence, IEEE Transactions on, 32(10), 1858-1870.

WEI, CHIA-HUNG, LIE. YUE (2010). Machine Learning Techniques for Adaptive Multimedia Retrieval, Capítulo 4, pág 71 IGI GLOBAL (2010).

XU, C., LI, S., TAN, T., & QUAN, L. (2009). Automatic 3D face recognition from depth and intensity Gabor features. Pattern recognition, 42(9), 1895-1905.

XU, C., TAN, T., WANG, Y., & QUAN, L. (2006). Combining local features for robust nose location in 3D facial data. Pattern Recognition Letters, 27(13), 1487-1494.

YAN, P., & BOWYER, K. W. (2007). Biometric recognition using 3D ear shape. Pattern Analysis and Machine Intelligence, IEEE Transactions on, 29(8), 1297-1308.

ZAPPA, E., MAZZOLENI, P., & HAI, Y. (2010). Stereoscopy based 3D face recognition system. Procedia Computer Science, 1(1), 2521-2528.

]]>ZHANG, D. D. (2013). Automated biometrics: Technologies and systems (Vol. 7). Springer Science & Business Media. Cap. 4 pág. 64

ZHANG, Z. (2012). Microsoft kinect sensor and its effect. MultiMedia, IEEE, 19(2), 4-10.

Recibido: 03/09/2016

Aceptado: 20/12/2016